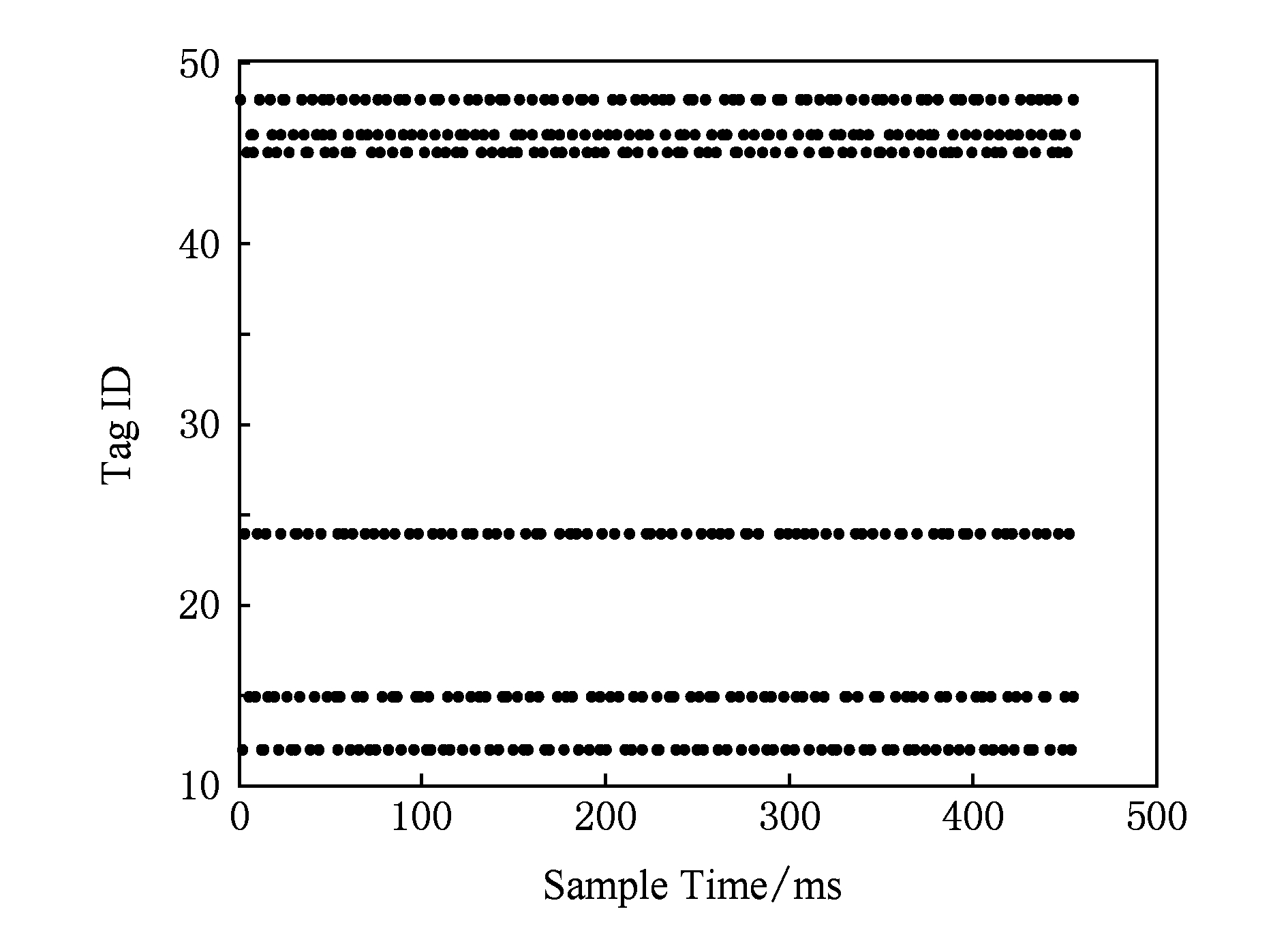

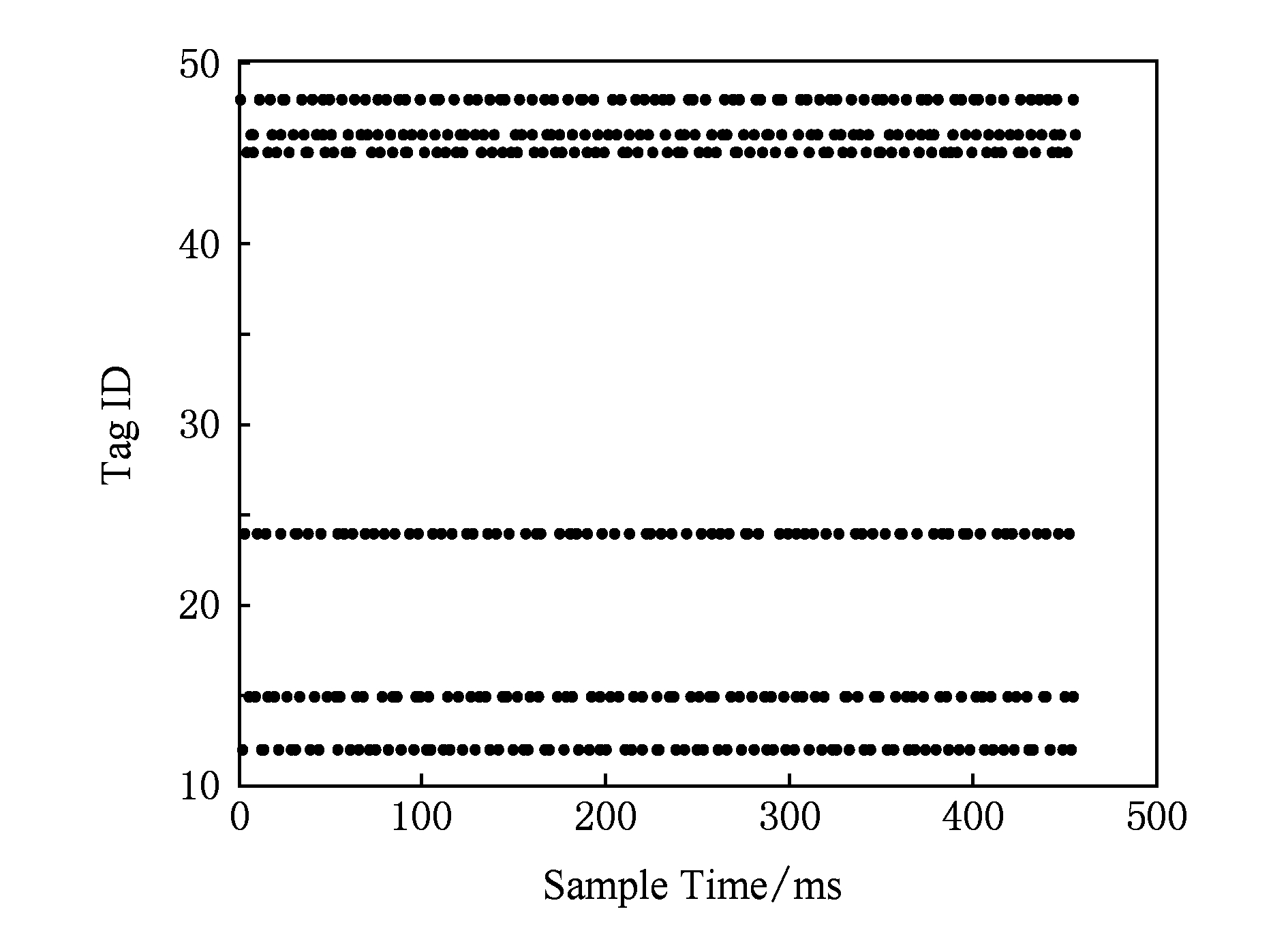

Fig. 1 Packet distribution in time domain

图1 数据包在时域的分布

王 旋 方河川 常俪琼 王 举 陈晓江 房鼎益 彭 瑶 陈 峰

(西北大学信息科学与技术学院 西安 710127)

(wxkate@stumail.nwu.edu.cn)

摘 要 近年来手势识别作为人机交互的重要组成部分,受到广泛的关注.很多应用受益于手势识别,比如智能手机、智能家居、体感游戏等.与现有基于射频识别(radio frequency identification, RFID)的手势识别系统相比,基于RFID的免携带设备(device free)手势识别方法,不需要用户携带任何设备,因此有更好的用户体验.其主要思想是利用手势动作对信号的干扰信息作为指纹特征,并且利用多径增加匹配难度,从而保证了手势识别的准确度.具体思路为:通过数据分片解决RFID通信在时域上不连续的问题,进而采用雷达中合成孔径雷达(synthetic aperture radar, SAR)算法获取每个手势对应的指纹特征矩阵.最后,借鉴动态时间归整(dynamic time warping, DTW)算法匹配先验手势指纹库,从而完成手势识别.真实环境下的实验结果显示该方法可达到约85%的正确识别率,证明给出方法具有很高的可行性.

关键词 无线手势识别;射频识别;免携带设备;合成孔径雷达;动态时间归整

21世纪的今天,智能设备云集,交互的方式也越来越丰富、越来越人性化.手势识别作为人机交互的重要组成部分受到广泛关注,成为研究的热点 [1-7] .手势识别使得很多应用成为可能,例如用户可以在有触摸屏幕的智能手机、平板电脑或笔记本电脑上写字、支付和画画,智能家居中利用手势操控家电等.甚至有文献[5,8]提出用手在空中自由书写,实现和移动设备的交互——如控制音量或接听电话,为人们的生活带来便利.

随着无线技术的快速发展,很多文献提到射频信号可以穿过墙体,且不受烟、雾和光照的影响 [9] ,因此,利用射频信号且无需携带任何设备的免携带设备(device free)手势识别成为研究热点 [5,10-12] .常见的device free无线手势识别技术利用多个天线的信道状态信息(channel state information, CSI) [13] 或者接收信号强度(received signal strength, RSS) [14] 估计信号到达接收端的角度进行手势识别,通常需要专用设备 [14] ,而且在实际部署存在多径时,射频信号的RSS值和CSI振幅受多径影响严重,导致现有手势识别技术准确度极大下降,鲁棒性降低.

由于多径对射频信号的影响较大,之前的方法是尽量消除多径带来的影响.如果我们可以使用射频信号细粒度的相位信息,结合信号强度信息进行识别,并且利用手势动作对多径信号的影响在匹配环节增加识别难度,那么就能够提高手势识别精度.

同时,射频识别(radio frequency identification, RFID)技术不仅容易获取信号的特征信息,且有着广泛的工业前景,便于普及与实际应用.随着RFID定位技术 [15-17] 的日渐成熟,很多科研人员开始研究将RFID技术用于手势识别.而且,与已提出的基于WiFi的手势识别方法 [5,18-19] 相比,基于RFID的手势识别成本较低.RFID标签是无源节点,靠无线电波携带的能量来产生信号,其内部结构简单,数据存储量大、体积小、价格低廉,每个大约0.5元人民币,而每个WiFi设备大都是在100元以上.

为此,本文提出一种基于RFID的Device Free手势识别方法,利用多径提高手势识别分辨率且部署成本低.其主要思想是根据手势的每一瞬间对信号的干扰不同,将受手势扰动信号的特征信息作为手势识别的指纹.利用RFID技术手势识别需要解决2项关键挑战:

1) RFID的通信协议决定了每个标签与阅读器之间的通信在时域上是离散的,即同一时刻只能有1个标签间歇通信,如图1所示.本文基于这一特点的思考,再结合RFID定位方法和图像识别的方法,在RFID手势识别时将采集来的数据按时间顺序划分成片,相当于将1个手势动作进行划分.

Fig. 1 Packet distribution in time domain

图1 数据包在时域的分布

2) 由于做手势时的起始时间、快慢等存在差异,匹配时需要比较相似性的2个时间序列的长度可能在时间轴上并不是对齐的,所以本文采用原本用于语音识别的动态时间归整(dynamic time warping, DTW)算法比较和归整2个时间序列,进而判断两者之间的相似性.

为验证所提出方法的性能,本文进行相应的实验.我们在教室里1个2.5 m×1.5 m的桌子上搭建实验平台,主要设备有4天线线性阵列、频率为920.875 MHz的阅读器、6个RFID标签,实验人员首先做10个手势作为先验指纹库,再随意作出手势进行识别.根据实验的统计结果表明本方法可达到约85%的正确识别概率,说明了本文给出方法具有很高的可行性.

现有的手势识别方法主要分为基于传感器技术的方法、基于图像识别技术的方法和基于射频信号的方法三大类别.利用传感器技术进行手势识别 [20] 主要依靠微机电系统(micro-electromechanical systems, MEMS)传感器(加速计、陀螺仪、磁力计等)提取手势的加速度和角速度信号特征量,根据手势信号的变化规律判断手势.该方法对于手势识别准确度有保证,但需要使用者佩戴传感器等设备,易用性能低,姿势获取的场景受限.

利用图像识别技术进行手势识别 [21] 主要依赖摄像头采集使用者的实时图像,再利用相关图形处理算法对每帧数据进行分析采样,取得图像特征.通过进一步分析多帧图像的特征变化规律,得到相应的手势特征.最后,利用匹配算法进行手势识别.该方法精度高,且用户不需要佩戴设备.但因为算法计算量大,需要性能强大的计算机进行数据处理.同时,摄像头不仅对光照强度和拍摄角度要求较高,而且必须要求使用者与摄像头之间没有障碍物遮挡.红外摄像头则部署成本高,环境适应性差 [22] .

现有的基于射频信号主要是利用无处不在的WiFi信号进行手势识别,例如WiSee [10] 根据测得WiFi信号下由于人的动作而产生的多普勒频移进行手势识别,由于射频信号可以穿透墙体传播,所以WiSee没有对视距的限制,但是该方法实现需要专用设备USRP,效果理想但成本开销较大,不适合广泛应用;WiGest [19] 使用通用设备,根据手势动作对信号强度的改变实现手势识别,识别高精度,但是没有真正解决多径问题,只是降低多径对结果的影响.

由于RFID标签体积小、价格便宜等特点,便于普及与实际应用,使基于RFID的手势识别技术成为国内外学者研究的热点.现有的基于RFID手势识别技术主要通过目标携带RFID标签,接收端通过分析RFID标签幅值或者相位的变化来识别手势.其中最具代表性的成果为Katabi等人的RF-IDraw虚拟写字 [8] ,通过用户手指携带RFID标签在空中书写英文单词或字母,接收端通过分析RFID标签的相位信息,追踪定位RFID标签的空间位置,实现空中书写字母的识别率为96.8%;FEMO方法 [22] 利用接收端获取用户携带无源标签产生的多普勒频移实现对10种健身行为的识别.

为了用户能够得到更好的体验,不再依赖传感器或者专用设备等辅助装置,本文提出根据手势动作对信号的干扰不同,将由阅读器获得信号的实时相位和强度信息数据按时间分片进行处理获取特征向量,再使用机器学习的方法进行手势识别,通过利用手势动作对多径信号的影响增加匹配难度,提高识别精度.在该方法中,使用者不需要携带额外的设备,且RFID标签价格低廉、部署简单.

由于RFID的通信在时域上是离散的,不能使用传统的基于连续变化信号特征的识别方法,因此将手势对信号的干扰信息通过基于数据分片的数据帧方法进行预处理.对预处理后的每帧数据,利用雷达系统中的合成孔径雷达(synthetic aperture radar, SAR)算法获取手势对应的特征矩阵,构成先验知识库.最后,使用DTW算法找出由新手势产生的特征矩阵与先验知识库中最匹配的特征矩阵,从而完成识别手势.

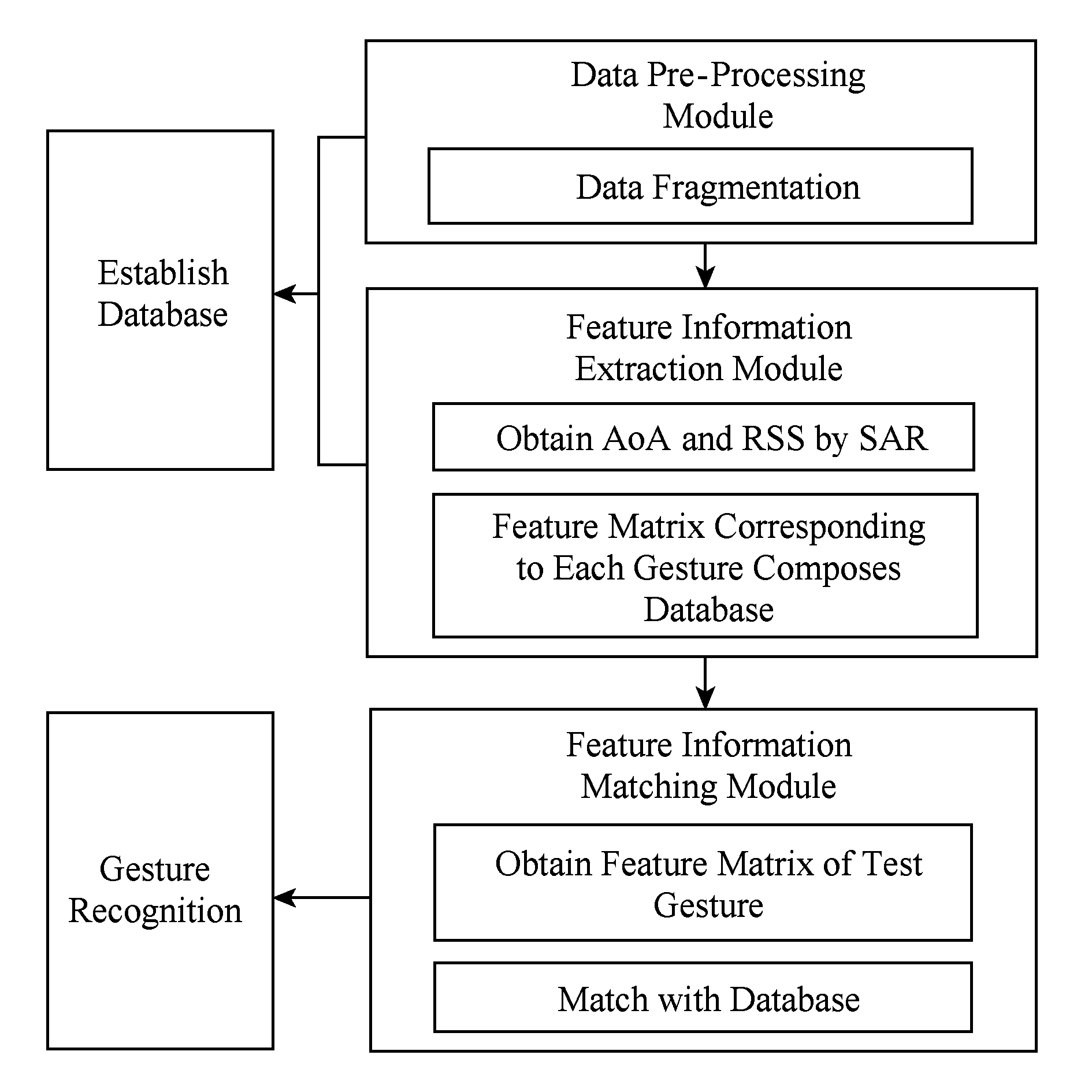

Fig. 2 Overview of key technologies

图2 关键技术框图

整体的手势识别方法的关键技术组成如图2所示.建立先验指纹库由数据预处理模块和特征信息提取模块构成,数据预处理模块主要是将收集的数据处理成帧,即对1个手势在多个采样点采样,可以用多个帧来描述1个手势.特征信息提取模块,是利用对每帧数据按标签号进行到达角(angle of arrival, AoA)估计,得到特征矩阵用来进行手势识别;对分成帧的数据确定其对应的特征点和物理坐标,用SAR算法估计AoA获取信号特征;特征信息匹配模块,利用本文改进的DTW算法比较和归整2个时间序列,使得代价总和最小,匹配手势,利用多径的影响增加匹配难度,提高识别精度.

RFID工作频率分为低频(low frequency, LF)、中频(medium frequency, MF)、高频(High Frequency, HF)、超高频(Ultra High Frequency, UHF)四种,工作在UHF下的RFID具有最远的通信距离,因此实验中采用UHF RFID.UHF RFID使用920 MHz左右的电磁载波通信,其通信信号是普通无线通信信号,具有相位( φ )、强度( A )、频率( f )三个基本属性,频率是已知的,故只要知道了信号的相位和强度就知道了整个载波信号的特征.

由RFID阅读器可获得到的数据分别有:相位( φ )、强度( A )、标签号( ID )、时间( T ),那么获取到的信息可以表示为

Antenna j =( φ , A , ID , T ),

其中, φ =( φ r )′, A =( A r )′, ID =( ID r )′, T =( T r )′, r 是数据包序号, r =1,2,…, N ; j 是天线编号, j =1,2,…, M .

建立先验知识库,用于待识别手势与其进行匹配.先将因手势对RFID信号的扰动获取到的相位和强度等数据进行分片,再计算每一帧数据对应的特征向量,构成该手势的特征矩阵,同理也可得到其他手势的特征矩阵,那么所有手势的特征矩阵就构成先验指纹库.

3.2.1 数据分片

由于RFID的通信在时域上是离散,不能保证每个手势都有连续的信号,如果直接去做匹配,可能出现偶然误差,所以不能使用传统的基于连续变化信号特征的识别方法.本文受到图像识别方法中帧的概念,即对1个完整连续的动作进行分时采样的启发,提出在分析数据时将数据按时间顺序划分成片,即处理成帧,帧的数量决定了1个手势的采样点数量.分帧,相当于将我们采集到的1个手势划分成不连续的几个瞬间位置,由顺序位置来描述1个手势,每个位置对应1个数据帧.

数据按时间先后采集,因此 Antenna j 中数据按时间顺序排列,可将其顺序划分成等数量的 n 份,则每一份的数据量为 k = ![]() ,如此,将数据分为 n 帧,即:

,如此,将数据分为 n 帧,即:

Frame q =( Antenna 1 q , Antenna 2 q ,…, Antenna j q ),

其中, q =1,2,…, n .

本方法中可以使用多个标签作为信号源,分帧后对其进行分离,即对 Frame q 中的每个 Antenna 数据按Tag ID进行分离并归类,得到每个标签对应的数据:

Tag d =( Antenna 1 d , Antenna 2 d ,…, Antenna j d ),

其中, d 为Tag ID编号,此时 Frame q 的结构变为

Frame q =( Tag ![]() , Tag

, Tag ![]() ,…, Tag

,…, Tag ![]() ).

).

其中 ![]() 表示第 q 帧数据编号为 d 的标签对应的数据.

表示第 q 帧数据编号为 d 的标签对应的数据.

3.2.2 计算手势动作对应的特征矩阵

将每个天线得到的数据分成多帧后,分离出每个标签各自对应的数据信息.需要对 Frame q 的每个标签数据分析其对应的信号特征,本文中使用AoA估计的方法获取信号特征,其方法步骤如下:

1) 计算到达每个天线上的相位角

这一步处理的数据为每个标签的某帧数据,在数据 Antenna j 中第1列数据即为相位角,由于环境噪声,其数据可能会有一定的波动,为了使数据具有统计代表性,采用最高频次数据为真实数据,即:

![]() φ

φ ![]() ).

).

(1)

2) 计算每个天线收到的信号表达式

第1步已经获得了每个天线收到数据的相位信息,根据正弦波的特征, t 时刻的信号可表示为

(2)

计算出每个天线收到的信号,构成信号 S .

3) AoA估计

将矩阵 S 输入SAR算法,即可得到AoA估计,其参数有:①天线间距 Xd ;②角度取值步长Δ λ (单位为度).输出数据为

B =( P m ),

m =Δ λ ,2Δ λ ,…, ![]() .

.

其中, P 为AoA估计强度.

对每个手势,有 l 个标签的数据,因此每个手势对应 l 个向量 B .将 l 个向量 B 组成1组,即构成第 q 帧中1个手势对应的特征矩阵:

Action =( B 1 , B 2 ,…, B l ).

对 n 帧数据分别做以上操作,可得到某个手势的特征矩阵:

W =( Action 1 , Action 2 ,…, Action n ).

将所有手势对应的数据输入,即可得被收录手势对应的特征矩阵,那么所有手势的特征矩阵就构成知识库 DB ,用于手势匹配.

在作出待识别的手势 x 时,采集得到 M 个天线的数据,将 M 个天线的数据按照3.2节及3.3节方法处理可以得到 B x , Action x 以及手势 x 对应的特征矩阵 W x .

识别手势,即在 DB 中找出与 W x 最匹配的某个手势对应的特征矩阵,即可识别出使用者所做的手势.对于矩阵 Action ,其最终的每一个列向量都对应1条光滑曲线,匹配即找出相似的曲线.在手势识别实际应用中,由于个人习惯不同,导致不同用户在做相同手势时其臂展长度、手势持续时间产生不同差异,这与语音识别存在的问题相同,因此为解决这个问题,本文采用语音识别中常用的DTW算法.DTW算法核心思想是在时间轴上比较和归整待识别手势数据的时间序列,将输入的待识别手势时间轴非线性地映射到先验知识库的时间轴,使得所有元素的对齐代价和最小,判断两者之间的相似性,进行匹配.

DTW算法输入2个待匹配曲线对应的矩阵,即可输出曲线的相似程度.对序列对中的任意元素对 Action ( α )和 Action x ( β ), α ∈[1, u ], β ∈[1, v ],元素间的欧几里德距离即为对齐代价,即:

C α , β =| Action ( α )- Action x ( β )|.

(3)

则序列归整的代价总和 C 为 u × v 的矩阵.设 Z 为矩阵 C 中元素对的对齐排列, Z =( z 1 ,…, z h ,…, z H ),其中max( u , v )≤ H ≤ u + v -1,且 z h =( α h , β h ).DTW算法即是寻找排列 Z 使得代价 C 最小,即:

(4)

且满足条件:

1) 边界条件: z 1 =(0,0), z ω =( u , v );

2) 单调性条件:

3) 窗口条件:| α h - β h |≤ Q , h =1,2,…, H .

当序列对元素的差异大于 Q (一般取 Q = H /6)时,则认为序列对对应2个不同手势.窗口条件只要求计算代价矩阵 C 中沿对角线宽度为2 Q 的元素,计算复杂度大大降低.

将某手势获取到的序列 W x 与先验指纹库 DB 中各个手势对应的特征矩阵进行匹配,当待识别手势的特征矩阵中每一列都与指纹库 DB 中某手势特征矩阵的对应列取得较小的匹配代价,且所有列的代价总和最小,则认为该手势与知识库中对应的该手势是同一手势,即成功识别.

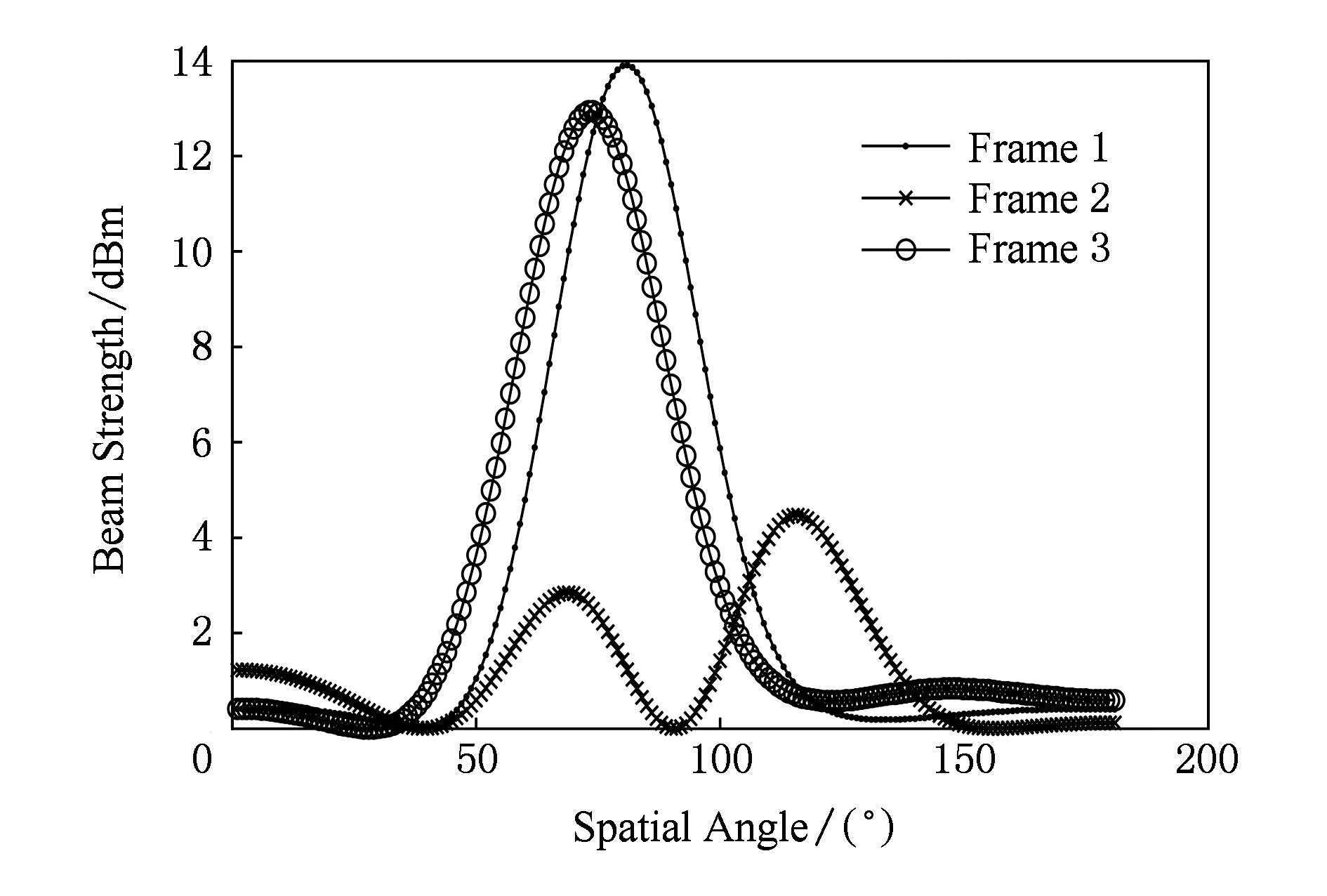

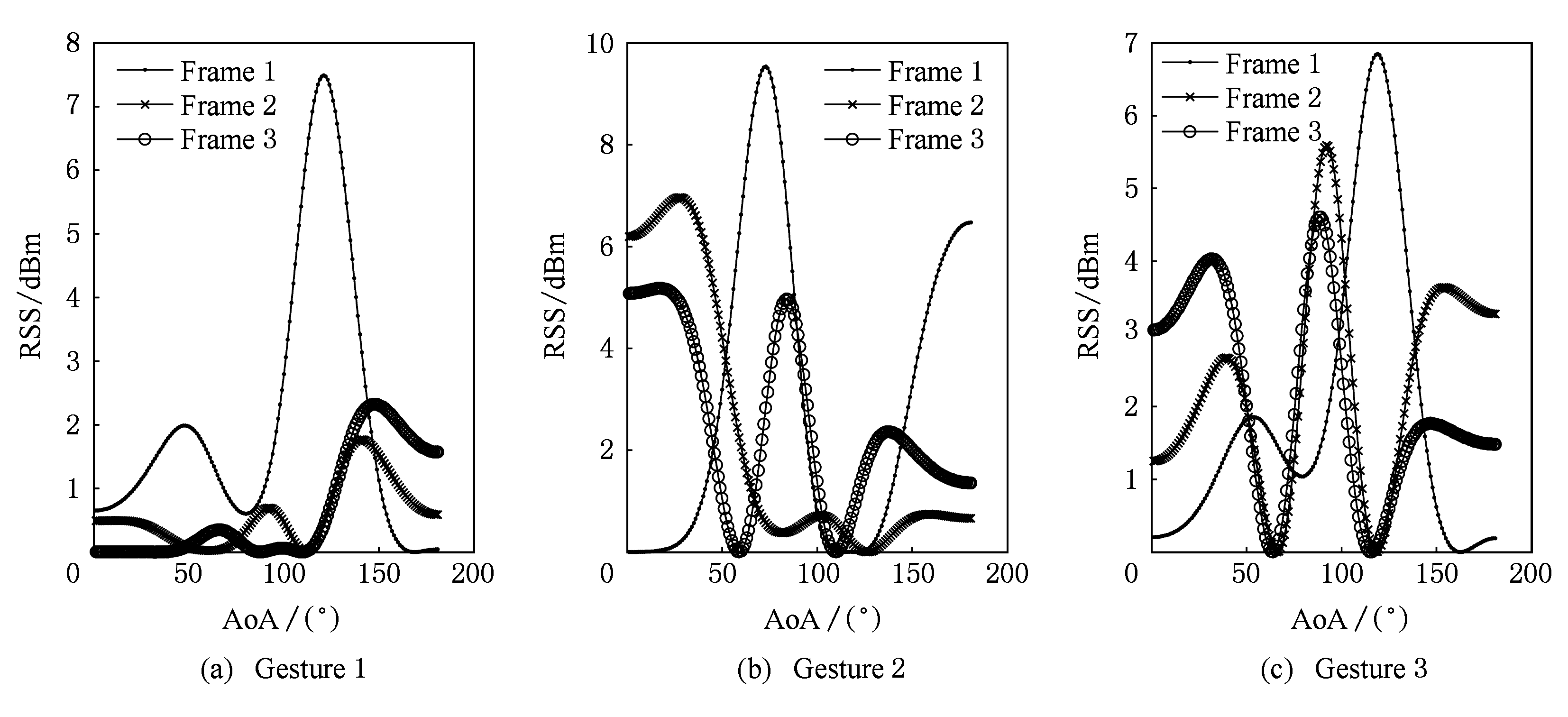

在用户作出手势的时候,用户的肢体可能遮挡一部分路径使一些方向上的信号减弱,或者可能反射信号产生新的多径.图3是同一手势的3个数据帧生成的AoA估计特征曲线,其中Frame 2的曲线表明该标签在用户肢体的影响下形成了1个新的信号路径.因此,在匹配环节,多径将增加对信息的匹配难度,从而提高识别精度.

Fig. 3 Characteristic curve of AoA estimation

图3 AoA估计特征曲线

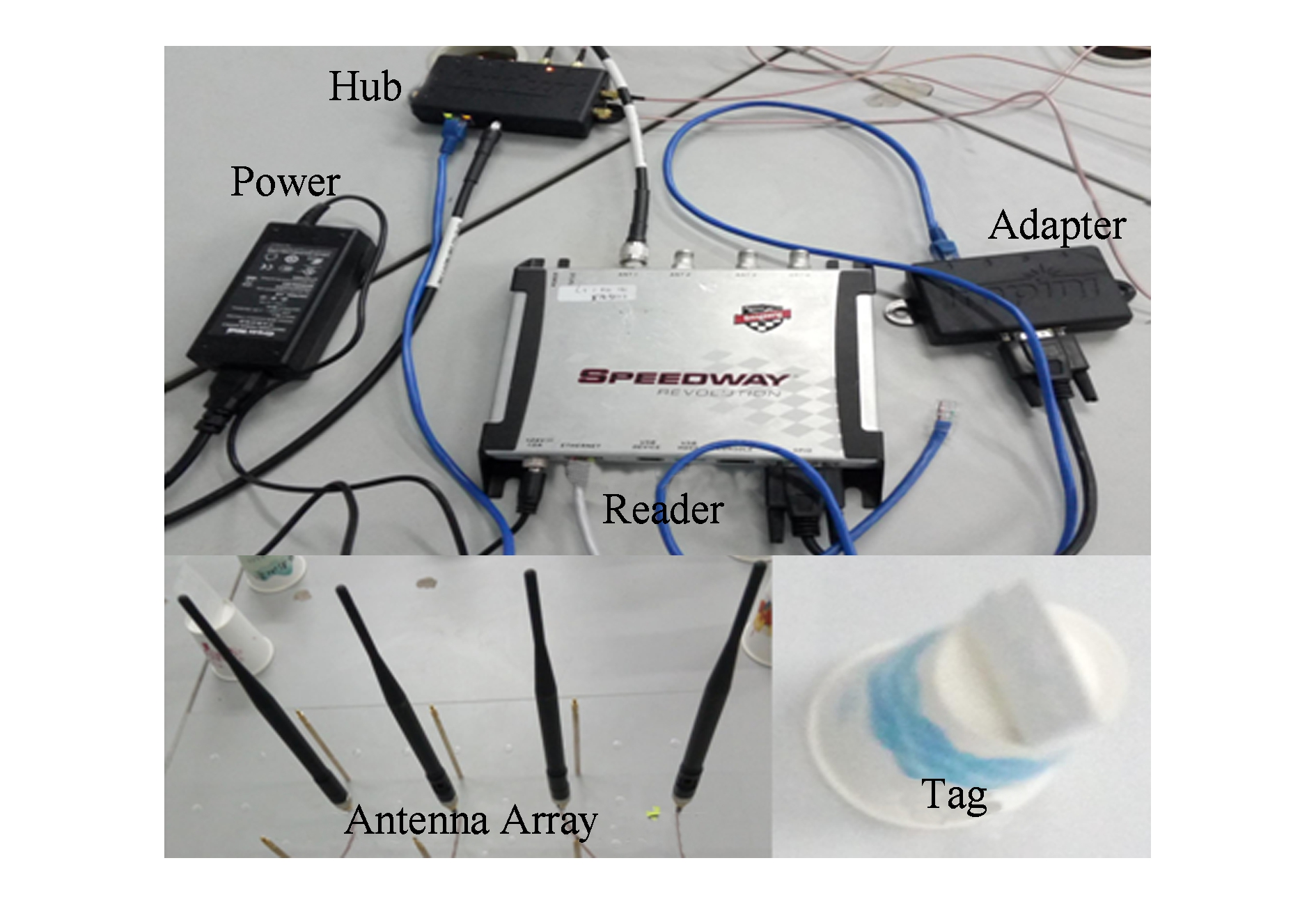

Fig. 4 Experimental equipment

图4 实验设备

我们在7 m×10 m的教室中1个2.5 m×1.5 m的桌子上部署实验场境.使用频率设定为920.875 MHz的ImpinJ RFID阅读器采集标签反射的数据,实际传输距离大约为2 m.实验中参数选择:天线个数 m =4,标签个数 l =6,数据分帧数 n =3.4个天线构成线性阵列连接至阅读器的1~4号扩展口,为提高精度、减少阵列位置误差,这4个天线放置在1个元件间距为4 cm的天线固定板上.天线尽量笔直地放在天线固定板上.测量时以天线中心或固定板天线插孔的中心为参考点.

选用6个标签放置于阵列前方,尽量保证标签正对天线,位于天线半高处,即与天线的半高中心处在同一水平线上),并且分散放置在阅读器的可读取范围内作为信号源.实验器材如图4所示,场景部署如图5所示.

Fig. 5 Experimental deployment

图5 实验部署图

建立指纹库有2种方案:1)每个手势做多次,然后循环匹配,去除掉匹配不上的误差数据,其余的作为库.在匹配环节,只要未知手势与库里的某次数据匹配,就可以认为匹配.2)每个手势做多次,循环匹配,找到和每次数据匹配程度都很高的数据组作为知识库,匹配环节只和这一组数据进行匹配.方案2相比方案1精度略低,但匹配环节计算量要小很多.因此我们选择方案2建立指纹库.

在搭建的实验场景中,实验人员共作出10个设定好的手势,如图6所示,每个动作做10次,将获取到的数据输入,按照第3节和方案2所述过程得到先验知识库.

Fig. 6 Ten pre-set gestures

图6 10个预先设定的手势

Fig. 7 Characteristic curves of three different gestures

图7 3个不同动作对应Tag1的特征曲线

实验人员随机作出手势,将得到的数据使用3.2节所介绍的算法,可以获得每个标签对应的特征向量.图7展示了同一个标签对应的3个不同的动作数据得到的特征曲线.可以看出图7(a)与图7(c)中Frame1数据特征曲线相近且都与图7(b)中Frame1曲线差别很大.图8展示了3次相同动作对应同一标签的数据得到的特征向量曲线,可以看出3幅图中每条曲线的形态都很相近.

Fig. 8 Characteristic curve of the same gesture

图8 3次同一动作对应Tag1的特征向量曲线

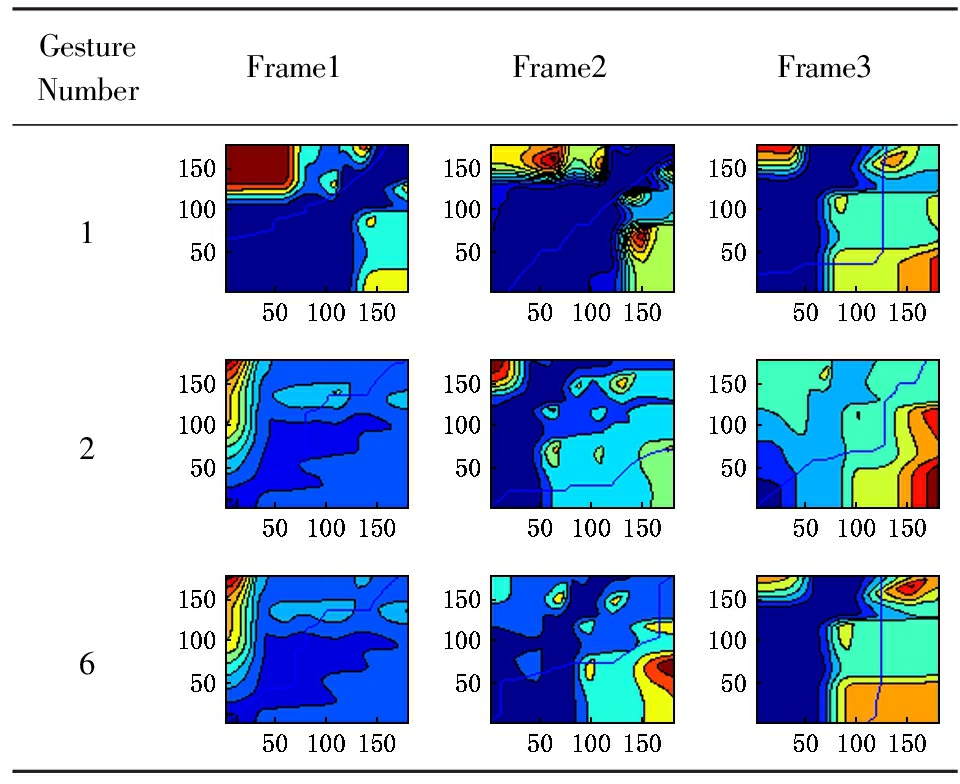

为了进一步量化相似与相异,将数据输入DTW算法进行归整计算,输出的数据可以量化距离,其输出图像可以直观看出匹配程度.表1给出了使用DTW算法匹配时输出的直观图形,为某手势与先验指纹库中手势匹配时DTW输出数据所绘制的图形.

Table 1 DTW Effect

表1 DTW效果展示

第1行为该手势与知识库中手势1对应的特征向量的匹配结果,可以看出2个手势所对应的特征向量可以匹配成功;第2行为手势与知识库中手势2的匹配结果,可以明显看出,基本没有匹配上的特征向量;第3行为该手势与知识库中手势6的匹配结果,也基本匹配不上.因此,认为该手势与知识库中的手势1为同一个手势,即手势识别成功.

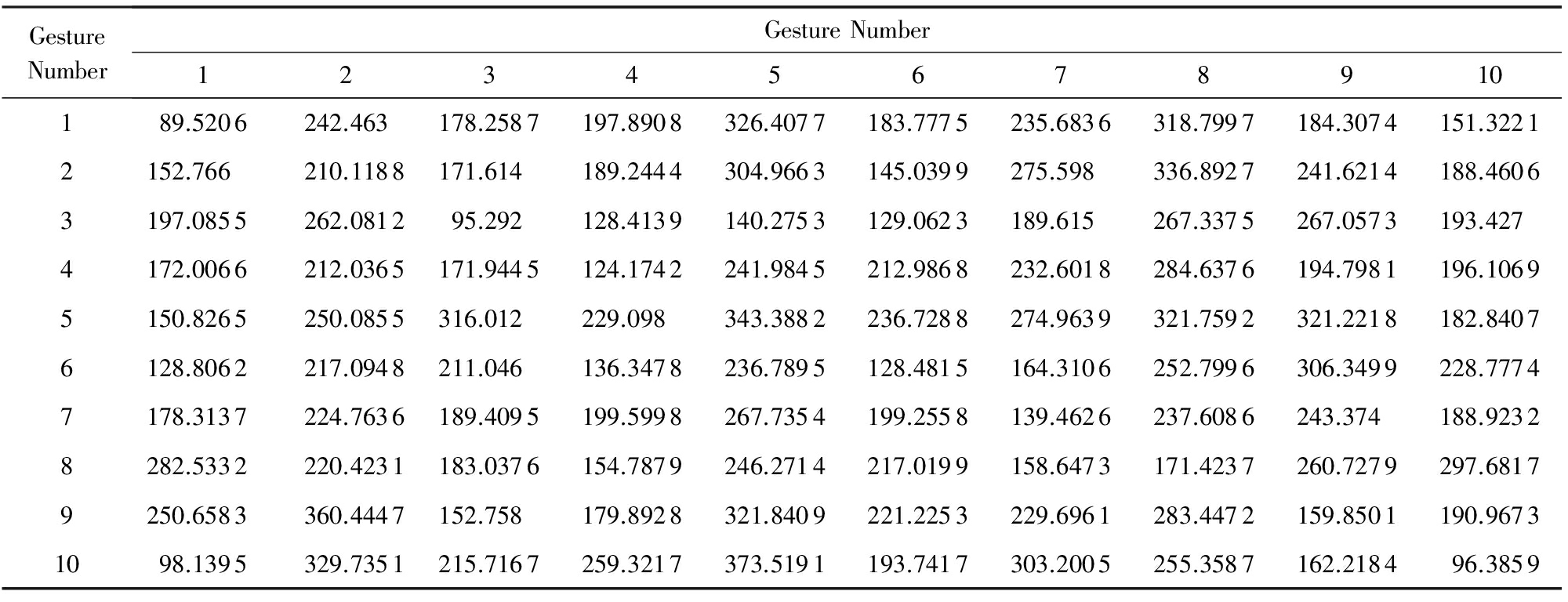

为了进一步探究本文所提出方法的科学性,实验者随机做手势,每个手势重复10次,获取相应的数据.按照前面所述的方法进行匹配,并统计匹配结果.

表2展示了某次实验数据在匹配时输出的代价矩阵,从表2中可以直观地看出:只有第5组识别不正确,其他组均能正确识别.根据所做实验识别结果的统计结果表明:本方法可达到约85%的正确识别概率,证明本文给出方法具有很高的可行性.

Table 2 Matching Cost Matrix

表2 匹配代价矩阵

手势识别是人机交互的重要组成部分,在智能家居、体感游戏等领域具有很大的应用前景,为人们的生活带来便利.本文提出的基于RFID技术的手势识别,成本低廉、实现简单.该方法根据实际情况提出数据分片的方法对数据进行预处理,再使用SAR算法进行特征向量获取,最后使用DTW算法进行高分辨率手势识别.通过实际实验验证了本文提出的方法确实可以实现手势识别,如果该方法趋于成熟,将在智能家居上起到非常大的作用.但是仍然存在3个方面的不足:

1) 实验中发现RFID数据的获取速度较慢,手势持续时间较短时,获取到的数据量变少,在分片处理时会增加偶然误差对手势识别精度的影响.

2) 可识别手势的数量限制于数据分片的数量和RFID阅读器获取相应数据的精确程度.当分片增加时,手势识别数量增加,每片数据量变少,偶然误差增大.

3) 分片数量以及分片数据的归整算法需要进一步优化.

对于以上存在的问题,我们将在以后的深入研究过程中探索更详尽的解决方案,比如增加数据去噪部分,使得精度和识别速度都能得到显著的提高.

参考文献

[1]Kellogg B, Talla V, Gollakota S. Bringing gesture recognition to all devices[C] //Proc of the 11th USENIX Conf on Networked Systems Design and Implementation. Berkeley, CA: USENIX Association, 2014: 303-316

[2] Ziaie P, Muller T, Knoll A. A novel approach to hand-gesture recognition in a human-robot dialog system[C] //Proc of the 1st Workshop on Image Processing Theory, Tools and Applications. Piscataway, NJ: IEEE, 2008: 1-8

[3] Xie Renqiang, Cao Juncheng. Extensible gesture recognition based on acceleration sensor[J]. Chinese Journal of Sensors and Actuators, 2016, 29(5): 659-664 (in Chinese)(谢仁强, 曹俊诚. 基于加速度传感器的可扩展手势识别[J]. 传感技术学报, 2016, 29(5): 659-664)

[4] He Chao, Hu Zhangfang, Wang Yan. A dynamic gesture recognition method based on improved DTW algorithm[J]. Digital Communications, 2013, 40 (3): 21-25 (in Chinese)(何超, 胡章芳, 王艳. 一种基于改进DTW算法的动态手势识别方法[J]. 数字通信, 2013, 40(3): 21-25)

[5] Sun Li, Sen S, Koutsonikolas D, et al. WiDraw: Enabling hands-free drawing in the air on commodity WiFi devices[C] //Proc of the 21st Int Conf on Mobile Computing and Networking. New York: ACM, 2015: 77-89

[6] Badi H S, Hussein S. Hand posture and gesture recognition technology[J]. Neural Computing & Applications, 2014, 25(3): 871-878

[7] Blum M. After the Kinect, what’s next for gesture-recognition technology?[J]. Pakistan Journal of Biological Sciences Pjbs, 2010, 13(14): 691-698

[8] Wang Jue, Vasisht D, Katabi D. RF-IDraw: Virtual touch screen in the air using RF signals[J]. ACM SIGCOMM Computer Communication Review, 2015, 44(4): 235-246

[9] Youssef M, Mah M, Agrawala A. Challenges: Device-free passive localization for wireless environments[C] //Proc of the 13th ACM Int Conf on Mobile Computing and Networking. New York: ACM, 2007: 222-229

[10] Pu Q, Gupta S, Gollakota S, et al. Whole-home gesture recognition using wireless signals[J]. ACM SIGCOMM Computer Communication Review, 2013, 43(4): 485-486

[11] Wang Yan, Liu Jian, Chen Yingying, et al. E-eyes: Device-free location-oriented activity identification using fine-grained WiFi signatures[C] //Proc of the 20th Int Conf on Mobile Computing and Networking. New York: ACM, 2014: 617-628

[12] Joshi K, Bharadia D, Kotaru M, et al. WiDeo: Fine-grained device-free motion tracing using RF backscatter[C] //Proc of the 12th USENIX Conf on Networked Systems Design and Implementation. Berkeley, CA: USENIX Association, 2015: 189-204

[13] Tan Sheng, Yang Jie. WiFinger: Leveraging commodity WiFi for fine-grained finger gesture recognition[C] //Proc of the 17th ACM Int Symp on Mobile Ad Hoc Networking and Computing. New York: ACM, 2016: 201-210

[14] Huang Yungfa, Yao Tsungyu, Yang Huajui. Performance of hand gesture recognition based on received signal strength with weighting signaling in wireless communications[C] //Proc of the 18th Int Conf on Network-Based Information Systems. Piscataway, NJ: IEEE, 2015: 596-600

[15] Wang Jue, Katabi D. Dude, where’s my card? RFID positioning that works with multipath and non-line of sight[J]. ACM SIGCOMM Computer Communication Review, 2013, 43(4): 51-62

[16] Fortinsimard D, Bouchard K, Gaboury S, et al. Accurate passive RFID localization system for smart homes[C] //Proc of the 3rd IEEE Int Conf on Networked Embedded Systems for Every Application. Piscataway, NJ: IEEE, 2012: 1-8

[17] Chang Liqiong, Chen Xiaojiang, Meng Haining, et al. HALL: High-accuracy and low-cost RFID localization in large-scale environment[C] //Proc of the 14th Annual Int Conf on Mobile Systems, Applications, and Services Companion. New York: ACM, 2016: 17-17

[18] He Wenfeng, Wu Kaishun, Zou Yongpan, et al. WiG: WiFi-based gesture recognition system[C] //Proc of the 24th Int Conf on Computer Communication and Networks. Piscataway, NJ: IEEE, 2015: 1-7

[19] Abdelnasser H, Youssef M, Harras K A. WiGest: A ubiquitous WiFi-based gesture recognition system[C] //Proc of the 33rd IEEE Int Conf on Computer Communications. Piscataway, NJ: IEEE, 2014: 1472-1480

[20] Xiao Qian, Yang Ping, Xu Libo. A gesture recognition method based on MEMS inertial sensor[J]. Chinese Journal of Sensors and Actuators, 2013, 26(5): 611-615 (in Chinese)(肖茜, 杨平, 徐立波. 一种基于MEMS惯性传感器的手势识别方法[J]. 传感技术学报, 2013, 26(5): 611-615)

[21] Cao Chuqing, Li Ruifeng, Zhao Lijun, Gesture recognition based on depth image[J]. Technique Journal of Computer Engineering and Design, 2012, 38 (8): 16-18 (in Chinese)(曹雏清, 李瑞峰, 赵立军. 基于深度图像技术的手势识别方法[J]. 计算机工程, 2012, 38(8): 16-18)

[22] Ding Han, Shangguan Longfei, Yang Zheng et al. Femo: A platform for free-weight exercise monitoring with RFIDs[C] //Proc of the 13th ACM Conf on Embedded Networked Sensor Systems. New York: ACM, 2015: 141-154

Wang Xuan, Fang Hechuan, Chang Liqiong, Wang Ju, Chen Xiaojiang, Fang Dingyi, Peng Yao, and Chen Feng

( School of Information Science and Technology , Northwest University , Xi ’ an 710127)

Abstract As a vital component of human-computer interaction, gesture recognition has gained a lot of attentions in civilian applications recently. Many applications would benefit from such gesture recognition, e.g. smart phone, smart home system, Kinect, etc. In this work, we introduce an RFID (radio frequency identification) based solution to recognize gestures using COTS (commercial off-the-shelf) RFID tags and readers. The basic idea is treating signal features caused by perturbation of gestures as the fingerprint. Furthermore, we leverage multipath to increase the difficulty of matching, which provides a high recognition rate. Unlike past work, which required user to attach an RFID tag, our method does not require any device to be attached to users. Specifically, we solve the problem that RFID communication is discontinuous in time domain by data slicing. We then capture and extract characteristic matrix corresponding to each gesture by using a synthetic aperture radar (SAR). Finally, we adopt dynamic time warping (DTW) techniques to recognize gestures by matching with the priori gesture fingerprint database. We implement our method using a COTS RFID device and evaluate it with 6 commercial tags. Experimental results demonstrate that this device free method is feasible and it can achieve a correct recognition rate of about 85%.

Key words wireless gesture recognition; radio frequency identification (RFID); device free; synthetic aperture radar (SAR); dynamic time warping (DTW)

收稿日期: 2016-08-22;

修回日期: 2017-02-06

基金项目: 国家自然科学基金项目(61572402,61272461);陕西省教育厅自然科学基金项目(15JK1726)

This work was supported by the National Natural Science Foundation of China (61572402, 61272461) and the Natural Science Foundation of Shaanxi Provincial Education Department (15JK1726).

通信作者: 彭瑶(xyyiezi@163.com)

中图法分类号 TP393

Wang Xuan , born in 1993. PhD candidate. Her main research interest include localization and RFID.

Fang Hechuan , born in 1992. BE. His main research interest is IoT (fanghechuan@stumail.nwu.edu.cn).

Chang Liqiong , born in 1989. PhD. Her main research interest is IoT (changliqiong@stumail.nwu.edu.cn).

Wang Ju , born in 1989. PhD. His main research interests include localization and signal processing (ju-w@foxmail.com).

Chen Xiaojiang , born in 1973. PhD, professor. Member of CCF. His main research interests include IoT and wireless sensor networks (xjchen@nwu.edu.cn).

Fang Dingyi , born in 1959. PhD, professor. Member of CCF. His main research interests include IoT and network security (dyf@nwu.edu.cn).

Peng Yao , born in 1984. PhD, lecturer. Her main research interests include designs of low power RF communication circuits, digital signal processing and wireless communication.

Chen Feng , born in 1978. PhD, assistant researcher. His main research interest is wireless network (xdcf@nwu.edu.cn)