裂缝作为公共设施中一种常见现象,存在着重大的安全隐患.因此设计一种有效的裂缝检测方法对保障社会公共财产安全具有重要意义.早期的裂缝检测采用人工检测,由于其花费时间长,且易受主观判断影响,难以推广应用.因此,为了克服人为因素造成的主观误差,学者们提出了基于图像处理的自动检测方法,包括小波变换[1-2]、阈值分割[3-5]、方向各异性[6-7]、边缘算法[8-10]和直方图[11-13]等.这些方法通过机器进行检测,避免了人为误差的产生,同时大大提高了检测的效率,促进了检测技术的发展.但还是存在一些不足,当裂缝图像环境较为复杂时,这些方法很难获得准确的结果,因此需要进一步的研究.

近年来,随着深度学习的快速发展,其在裂缝检测领域中也得到了广泛应用.如墙壁裂缝检测[14-15]、桥塔和锚室表面裂缝检测[16-17]、路面裂缝检测[18-20]和混凝土裂缝检测[21-22]等.在进行裂缝检测时,深度学习方法不仅注重裂缝特征的提取,而且关注图像中的上下文信息,使最后提取的特征更加精准有效.但这些方法在提取裂缝特征时,易受到图像中噪声、光线、阴影等因素的干扰,导致预测结果出现偏差,降低检测准确度.针对此问题,本文设计了一个并行注意力机制,并将其嵌入到UNet网络的解码部分,进而提出了并行注意力UNet裂缝检测方法.该并行注意力机制分别从通道和空间2个维度对裂缝特征权重进行充分分配,然后将重新分配后的特征融合,以获得更具互补性的裂缝特征并抑制干扰.与串行结构的注意力机制相比,本文设计的并行注意力机制在精确捕获裂缝特征的同时,又能有效抑制各种干扰.

1 相关工作

目前,深度学习方法在裂缝检测领域被广泛应用.如Yao等人[23]提出了一种基于卷积神经网络的裂缝图像识别方法,该方法可以解决检测效率低、环境约束大的问题,并提高了检测速度和精度.Liu等人[24]提出了像素级分类网络UNet,该网络将局部信息与全局信息相结合,显著提高了裂缝特征提取的精确性.由于裂缝检测中的标注数据是人为标记的,这会导致裂缝标记的不精准,因此Ali等人[25]提出了一种基于卷积神经网络的路面裂缝自动检测算法,通过CNN网络与滑动窗口结合,准确定位裂缝所在位置,解决了人工标记的缺陷.Nie等人[26]提出了一种基于YOLO(You only look once) V3的路面裂缝检测方法,解决了传统路面裂缝检测实时性差、精度低的问题.

随着不断深入研究,学者们在现有网络的基础上进行了改进.Song等人[27]提出了一种高效的裂缝检测方法,通过建立多尺度空洞卷积模块来获取裂缝的上下文信息,并在此基础上引入一种注意力机制,进一步提取高层特征.为解决裂缝与周围路面对比度低的问题,Xiang等人[28]提出了一种端到端深度卷积神经网络的路面裂缝检测方法,该方法采用金字塔模块对复杂的裂缝拓扑结构进行全局上下文信息挖掘,并引入了一个空间-通道组合注意力模块来细化裂缝特征.Konig等人[29]提出了一个完全卷积UNet架构来自动化注释任务,并在该架构的基础上嵌入了基于注意力的门控机制,进一步传播ReLu激活.Wang等人[30]提出了一种改进的I-UNet网络,利用空洞卷积扩展卷积的接受域.将提取到的不同尺度特征进行多尺度融合,使改进后的网络具有更好的效果和鲁棒性.Fan等人[31]提出了U-Hierarchical Dilated Network(U-HDN),通过多尺度模块集成不同尺度的裂缝特征以获取更多的裂缝信息,并通过分层特征学习模块集成不同层的特征,以获取更精确的预测结果.为了克服各种类型的噪声,Li等人[32]提出了一种基于深度卷积神经网络(convolutional neural network, CNN)的图像裂缝检测方法,该方法首先训练CNN分类器,再将训练好的CNN分类器和滑动窗口结合进行穷举搜索,从而获得更精确的裂缝定位.针对隧道图像中裂缝细小且存在大量噪声问题,Li等人[33]提出了一种基于UNet和CliqueNet(convolutional neural networks with alternately updated clique)的卷积神经网络U-CliqueNet,通过Clique Block代替UNet的卷积层,实现更准确、快速地从背景中分离裂缝.Ren等人[34]提出了一种改进的深度全卷积神经网络CrackSegNet进行裂缝分割,该方法能有效提取多尺度特征,大大提高了网络整体的裂缝检测能力.这些网络相较之前的网络在检测效果方面有了较大的提升,但仍存在一些不足,例如检测结果中存在干扰或者无法较精准地分割出裂缝区域.

针对这些不足,目前比较流行的解决方案是嵌入注意力机制以抑制各种干扰.而现有的注意力机制大都采用串行结构,能有效抑制大部分干扰,但仍受到明亮噪声的影响,导致效果降低.针对此问题,本文设计了一种并行注意力机制,并提出了并行注意力机制UNet裂缝检测方法.该方法从空间和通道2个维度抑制干扰,通过并行结构融合两者特征以获取更具互补性的裂缝特征,有效抑制了各种干扰并提高了检测的精确度.

2 本文方法

本文提出了一种裂缝检测方法,在UNet网络中嵌入一个自行设计的并行注意力机制,以此来抑制各种干扰,提高裂缝特征提取的精准性.

2.1 网络结构

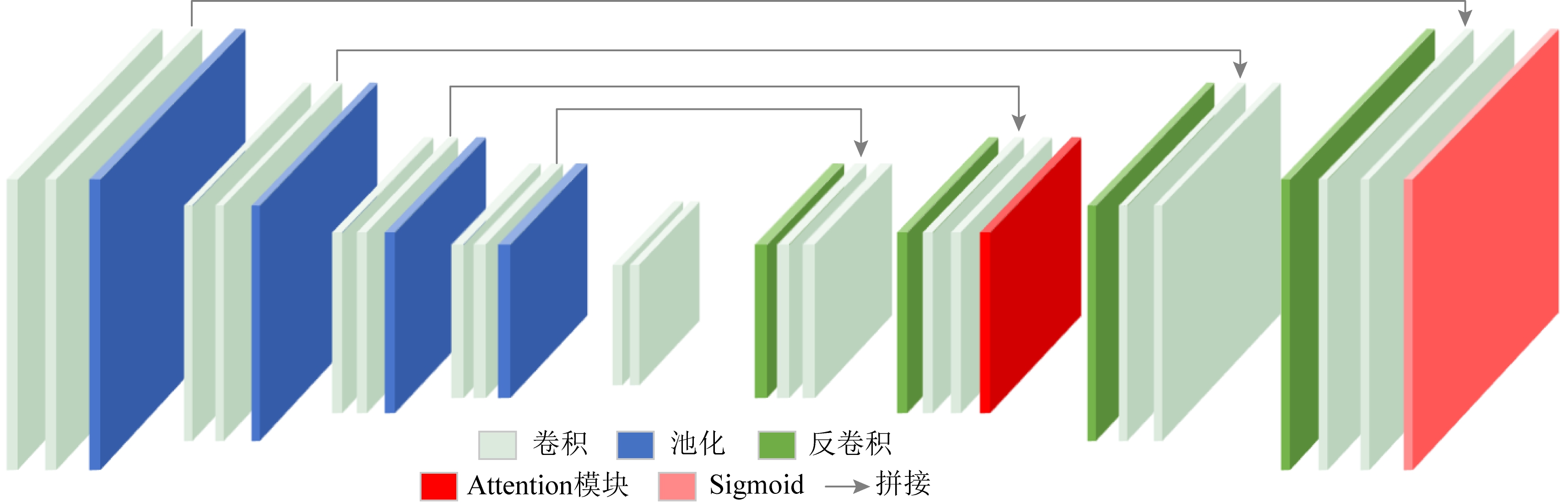

本文方法的网络结构如图1所示,主要由3部分组成.第1部分是网络的编码层,由卷积和池化组成;第2部分是网络的解码层,由卷积、反卷积和sigmoid函数组成;第3部分是注意力模块,即本文提出的并行注意力机制.

Fig. 1 The structure of parallel attention based UNet for crack detection

图1 基于并行注意力UNet的裂缝检测结构

模型训练过程中,首先将裂缝数据输入到网络的编码层,通过卷积池化提取图像中的裂缝特征,生成一系列的特征图.随后对这些特征图进行解码,在此过程中为了提高裂缝特征提取的精准性,嵌入了并行注意力机制,以抑制干扰、凸显裂缝特征.网络还将编码层的特征图与解码层的特征图进行拼接,进一步提高裂缝特征提取的精确度,从而大大提升检测效果.

Fig. 2 The parallel attention module

图2 并行注意力机制

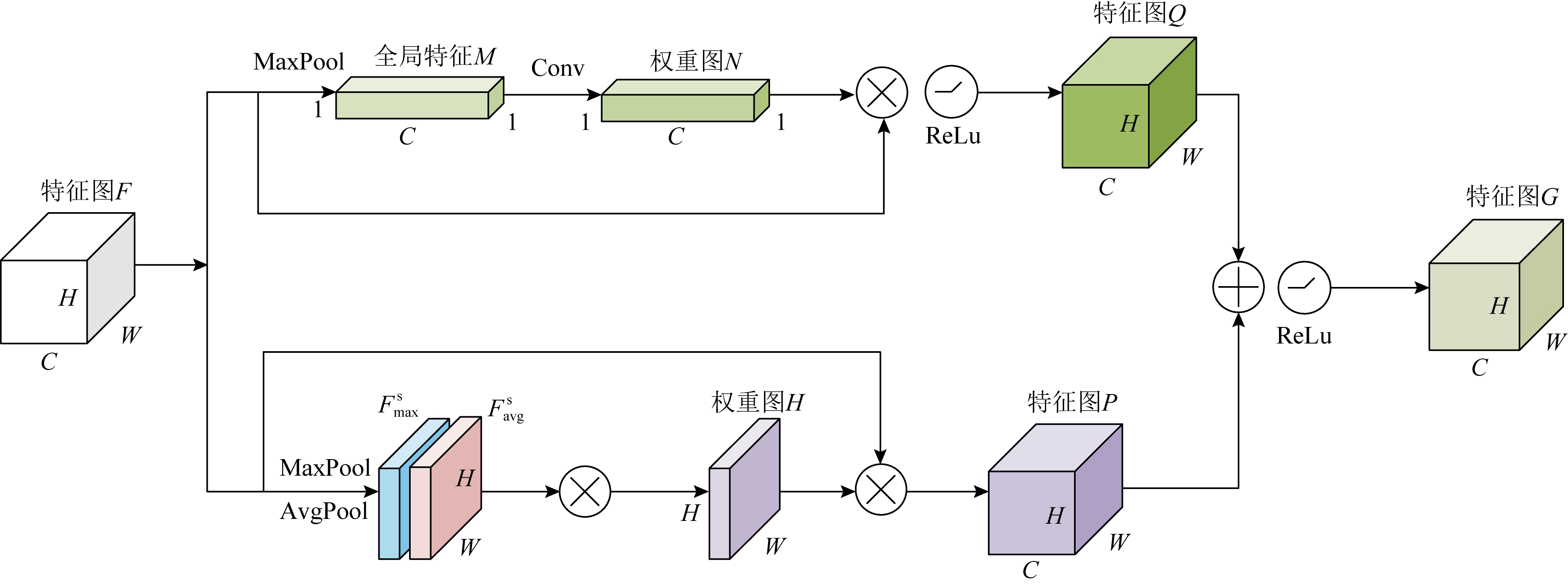

2.2 并行注意力机制

本文设计了一种并行注意力机制,其采用并行结构较大程度上解决了串行结构无法有效抑制各种干扰的弊端.如图2所示,并行注意力机制分为3部分:一部分是通道注意力,它通过一维卷积对特征图中的通道权重进行重分配,提高与裂缝相关通道的权重,降低其余通道的权重;第2部分是空间注意力,它结合2种池化方式对空间权重进行更合理的重新赋予,赋予特征图中潜在裂缝区域更高的权重,降低其余区域权重;第3部分是融合,将前2部分生成的特征进行融合,以获得更具互补性的特征.

1) 通道注意力.首先定义输入的特征图为F,对特征图F使用全局最大池化,生成一个1×1×C的全局特征M(其中C代表通道的数量).然后使用大小为k的一维卷积对全局特征M进行卷积,生成一个注意力权重图N.注意力权重图N中第i个通道的权值ei可由式(1)得到:

(1)

其中,![]() 表示用来学习生成第i个通道权值的第j个权重参数,

表示用来学习生成第i个通道权值的第j个权重参数,![]() 表示第i个通道k个相邻通道全局特征的集合.一维卷积的卷积核大小k可由式(2)得到:

表示第i个通道k个相邻通道全局特征的集合.一维卷积的卷积核大小k可由式(2)得到:

![]()

(2)

其中,C为通道数,γ和b为超参数,一般γ=2,b=1,|A|odd为与A相邻最近的奇数.随后通过权重图N对特征图F进行加权,产生特征图Q.在特征图Q中,与裂缝相关的通道权重得到了提升,其余通道权重则有所降低.

2) 空间注意力.对特征图F在通道维度上分别执行平均池化与最大池化操作,生成2个单通道的特征图:平均值特征图![]() 和最大值特征图

和最大值特征图![]() 随后将这2个单通道的特征图结合,生成一个权重图H.然后通过权重图H对特征图F进行加权,生成特征图P.在特征图P中,与裂缝相关的区域赋予了更高的权重,其余区域则降低了权重.空间注意力模块的计算为

随后将这2个单通道的特征图结合,生成一个权重图H.然后通过权重图H对特征图F进行加权,生成特征图P.在特征图P中,与裂缝相关的区域赋予了更高的权重,其余区域则降低了权重.空间注意力模块的计算为

MS(F)=σ([AvgPool(F)⊗MaxPool(F)])=![]()

(3)

其中,σ表示ReLu激活函数,⊗表示2个特征图对应位置数据的点积.

3) 融合.将特征图Q与特征图P相加后使用ReLu激活函数得到特征图G.特征图G融合了通道维度的权重分布和空间维度的权重分布,从而获得了更具互补性的特征,能更加凸显裂缝特征区域,并抑制各种干扰,使模型能更精确地识别出裂缝.

2.3 模型的训练

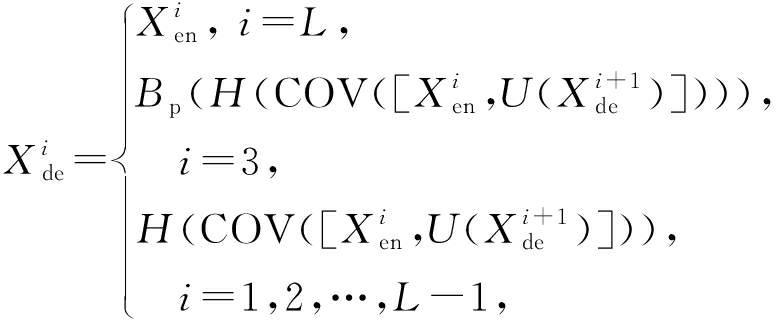

假设输入的数据为X,X经过编码后获得特征图![]() 其计算公式为

其计算公式为

![]()

(4)

其中,COV代表卷积操作,函数H表示特征聚合机制(卷积层+归一化),函数P代表下采样,L表示层数,本文中L=5.随后对获得的特征图进行解码,解码后的特征图为![]()

(5)

其中,[]代表通道维度的拼接,函数U代表上采样,函数Bp表示并行注意力机制操作.最后对解码的特征图进行sigmoid操作,获得最终的预测结果![]()

![]()

(6)

其中,![]() 是最终的解码特征图.

是最终的解码特征图.

在训练时,为了获得更合适的模型,需要对模型进行优化.本文对图像进行分割,这属于像素级的二分类问题,因此本文选取二值交叉熵损失函数(binary cross-entropy loss function)作为模型训练时的损失函数,其计算为

![]()

(7)

其中,yi是像素点i在标注数据中的像素值,![]() 是像素点i在训练结果

是像素点i在训练结果![]() 中的像素值.

中的像素值.

3 实 验

为验证模型的有效性,本文选取4个数据集:道路裂缝、大坝裂缝、Weizmann Horses[35]、MUCIC[36];4个网络:CNN[32],SegNet[37],VGG19(very deep convolutional networks)[38],CrackSegNet[34]和4个注意力机制:SE-Net(squeeze-and-excitation net-works)[39],ECA-Net(efficient channel attention for deep convolutional neural networks)[40],SAM[41],EC-SAM进行实验.实验分为3组:第1组是裂缝数据在不同网络中的对比实验;第2组是公共数据在不同网络中的对比实验;第3组是注意力机制的性能对比实验.为了让实验数据更准确,本文对每组实验均重复进行5次,然后取平均值作为最终结果.

3.1 数据集

本文数据集可以分为2类:一类是裂缝数据集,包括道路裂缝(114张训练图片、81张测试图片)和大坝裂缝(288张训练图片、83张测试图片),这2个数据集的标注都是裂缝,用来检测模型在不同裂缝数据中的性能;另一类是公共数据集,包括Weizmann Horses[35](237张训练图片、91张测试图片)和MUCIC[36](706张训练图片、291张测试图片),这2个数据集的标注是马和细胞,用来测试模型在其他目标数据集中的性能.

3.2 评价指标

为了更精确地评判模型性能,本文选取Precision(Pr)、Recall(Re)和F-Measure[42-43](F1)这3个指标进行衡量.其中Pr代表正确率指数,Re代表召回率指数,两者衡量了模型分割的准确性,其定义为

![]()

(8)

![]()

(9)

其中,TP,FP,FN分别代表真阳性、假阳性和假阴性的数量.为了获得更好的效果,Pr和Re的值应尽可能的高.由于本文检测的目标为裂缝,而裂缝在图像中的占比较小,导致Pr和Re会出现一定的矛盾,所以为了更好地评判模型性能给出了综合评价指标F1[42-43]:

![]()

(10)

其中,β2是超参数,用来权衡Pr和Re对F1的影响,当β2>1时Re对F1的影响较大,当β2<1时Pr对F1的影响较大.由于裂缝在图像中比重较小且图像中存在较多干扰,为了更精确地分割裂缝,评价指标F1应更侧重于Pr值,所以设置β2=0.3.本文还使用PR曲线对注意力机制进行性能评估.

3.3 参数设置

本文采用分辨率为512×512的图像训练PA-UNet.在训练中,卷积操作的卷积核大小为3×3,池化大小为2×2,反卷积操作的卷积核大小为2×2,编码的过滤器个数分别为 64,128,256,512和1 024,解码的过滤器分别为1 024,512,256,128和64.由于并行注意力机制在解码的第3层,因此输入并行注意力机制的特征图尺寸为128×128×256.本文使用Adam优化器训练PA-UNet,迭代次数为30,批量为1,学习率为10-4.

3.4 实验结果与分析

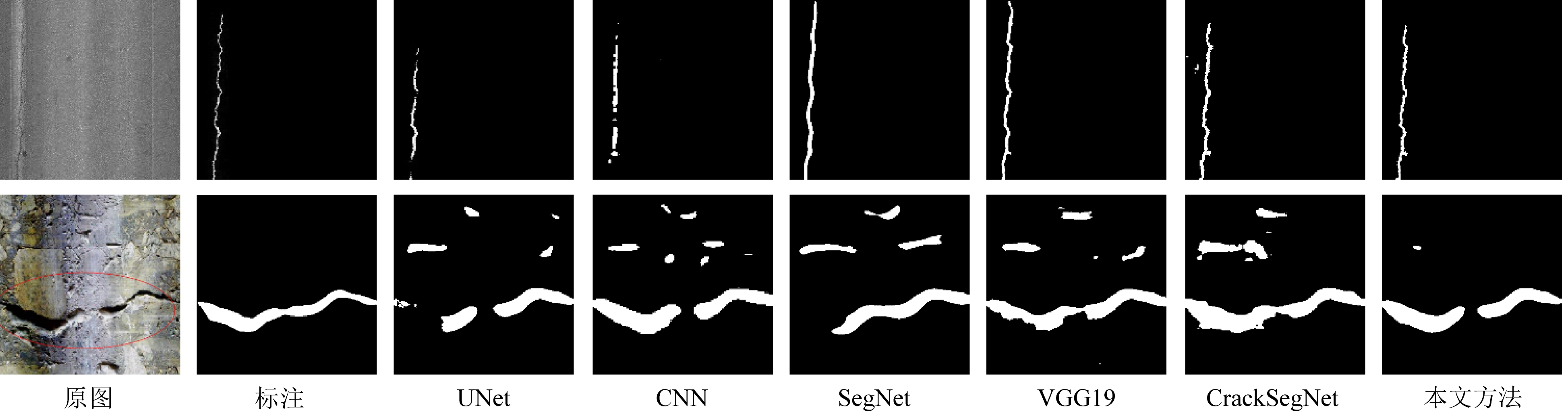

1) 裂缝数据集的对比结果

本组实验选取道路和大坝裂缝数据在不同网络中进行对比分析,其可视化结果如图3所示.在道路裂缝图像中,UNet和CNN的结果缺失较多,其他结果中存在较多干扰,只有本文结果与标注数据最接近.在大坝裂缝图像中,本文结果相较于其他结果干扰最少,效果最好.

Fig. 3 Visualization of crack data comparison results

图3 裂缝数据对比结果可视化

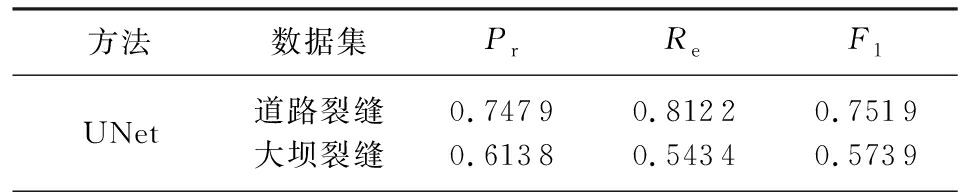

表1是本组实验的结果.相较于UNet,本文方法在道路数据中提升了2.95%,在大坝数据中提升了1.05%.数据说明相较于现有的主流方法,本文方法在裂缝检测时获得的效果最佳,从而证明了本文方法的有效性.

Table 1 The Results in Different Crack Datasets

表1 裂缝数据的对比结果

方法数据集PrReF1UNet道路裂缝大坝裂缝0.74790.61380.81220.54340.75190.5739

续表1

方法数据集PrReF1CNN道路裂缝大坝裂缝0.49210.57990.60510.53410.48480.5410SegNet道路裂缝大坝裂缝0.75770.52530.74450.66420.75190.5390VGG19道路裂缝大坝裂缝0.64200.60970.83470.50510.66650.5546CrackSegNet道路裂缝大坝裂缝0.65530.53870.90790.65980.69610.5481本文方法道路裂缝大坝裂缝0.77980.62520.82180.54370.78140.5844

注:黑体数字表示该指标最好的结果.

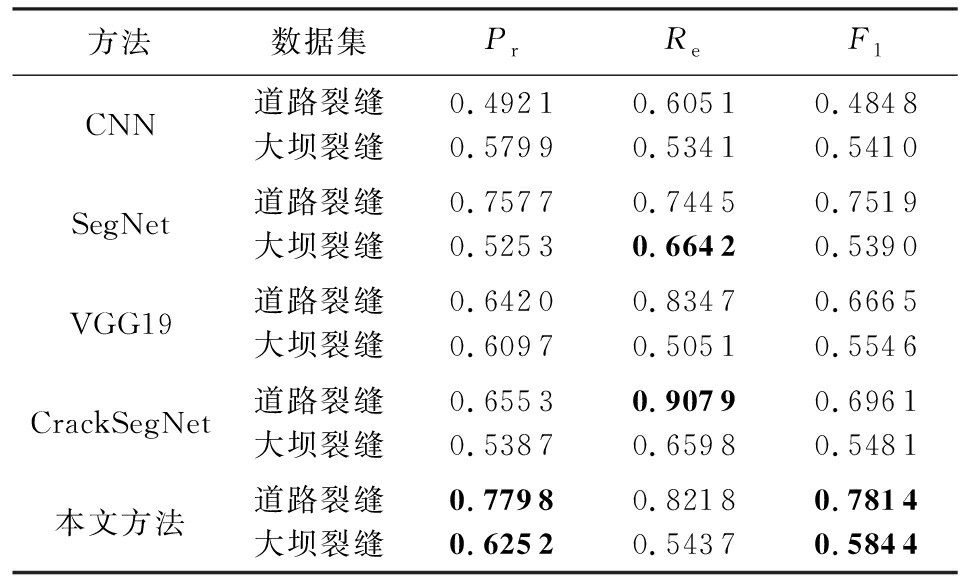

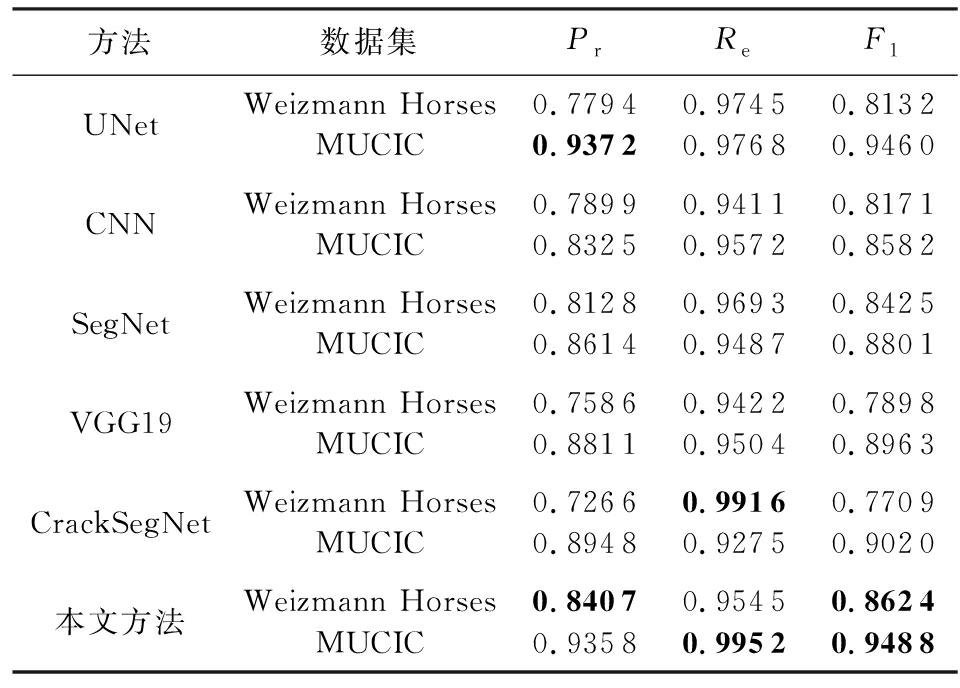

2) 公共数据集的对比结果

本组实验选取2个公共数据集(Weizmann Horses和MUCIC)进行对比分析,结果如图4所示.在Weizmann Horses中,相较于其他网络,本文方法的结果干扰最少,效果最佳.在MUCIC中,所有结果都较为相似,但本文方法的结果更接近标注数据.

Fig. 4 Visualization of public data comparison results

图4 公共数据对比结果可视化

表2是本组实验的结果.相较于UNet,本文方法在Weizmann Horses中提升了4.92%,在MUCIC中提升了0.28%.数据表明本文方法在其他目标数据集中也能获得最佳效果,进而说明本文方法具有一定的泛化性,也证明了本文方法的有效性.

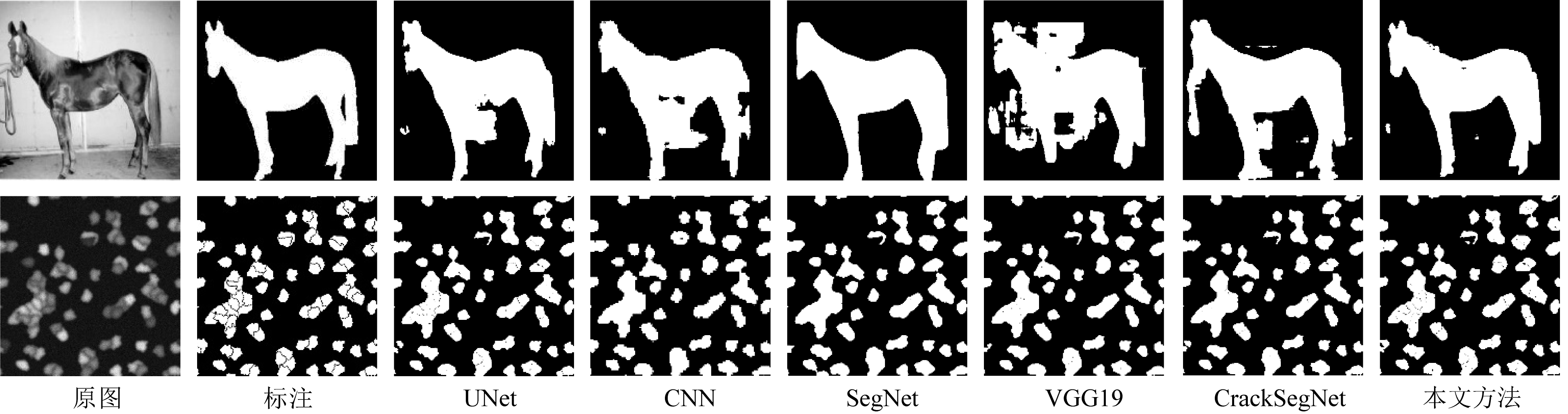

Table 2 The Results in Different Public Datasets

表2 公共数据的对比结果

方法数据集PrReF1UNetWeizmann HorsesMUCIC0.77940.93720.97450.97680.81320.9460CNNWeizmann HorsesMUCIC0.78990.83250.94110.95720.81710.8582SegNetWeizmann HorsesMUCIC0.81280.86140.96930.94870.84250.8801VGG19Weizmann HorsesMUCIC0.75860.88110.94220.95040.78980.8963CrackSegNetWeizmann HorsesMUCIC0.72660.89480.99160.92750.77090.9020本文方法Weizmann HorsesMUCIC0.84070.93580.95450.99520.86240.9488

注:黑体数字表示该指标最好的结果.

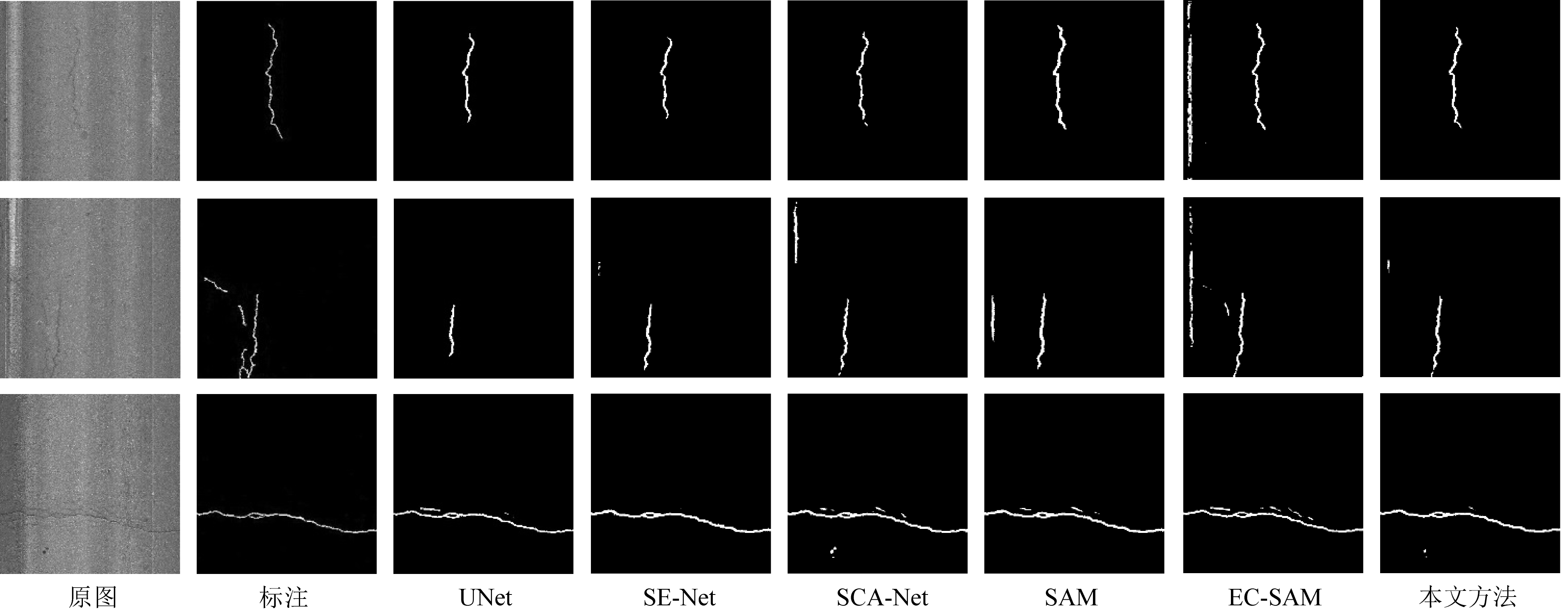

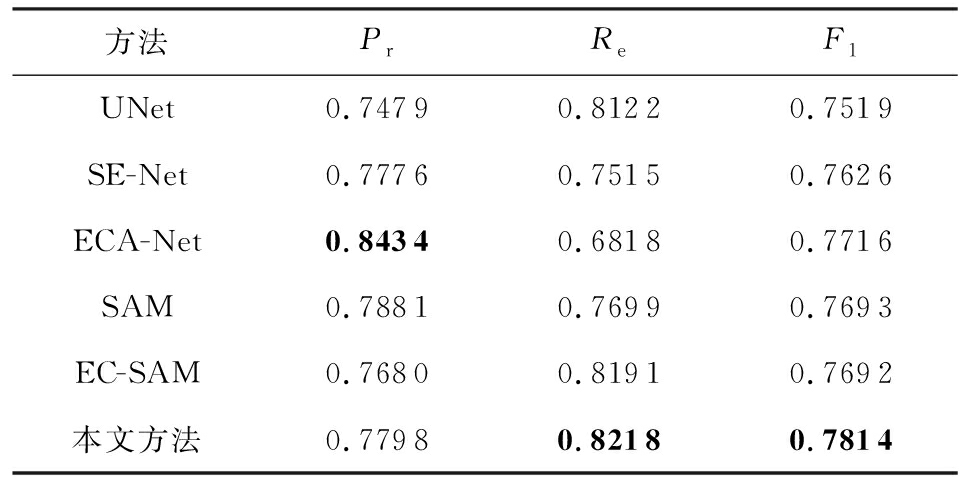

3) 不同注意力机制的对比结果

本组实验使用道路裂缝数据集,选择SE-Net[39],ECA-Net[40],SAM[41],EC-SAM(与CBAM(convo-lutional block attention module)[44]类似的串行结构注意力机制)4个注意力机制与并行注意力机制进行对比分析,其结果如图5所示.第1行中,并行注意力机制和SAM的结果最好,SE-Net和ECA-Net的结果有缺失,EC-SAM的结果最差.第2行中,这些结果与标注数据都有较大的偏差,但相较而言,并行注意力机制和SE-Net的结果最好,干扰最小.第3行中,本文方法和SE-Net的效果最佳,其他方法均存在较多干扰.

Fig. 5 Visualization after adding different attention mechanisms

图5 不同注意力机制的对比结果可视化

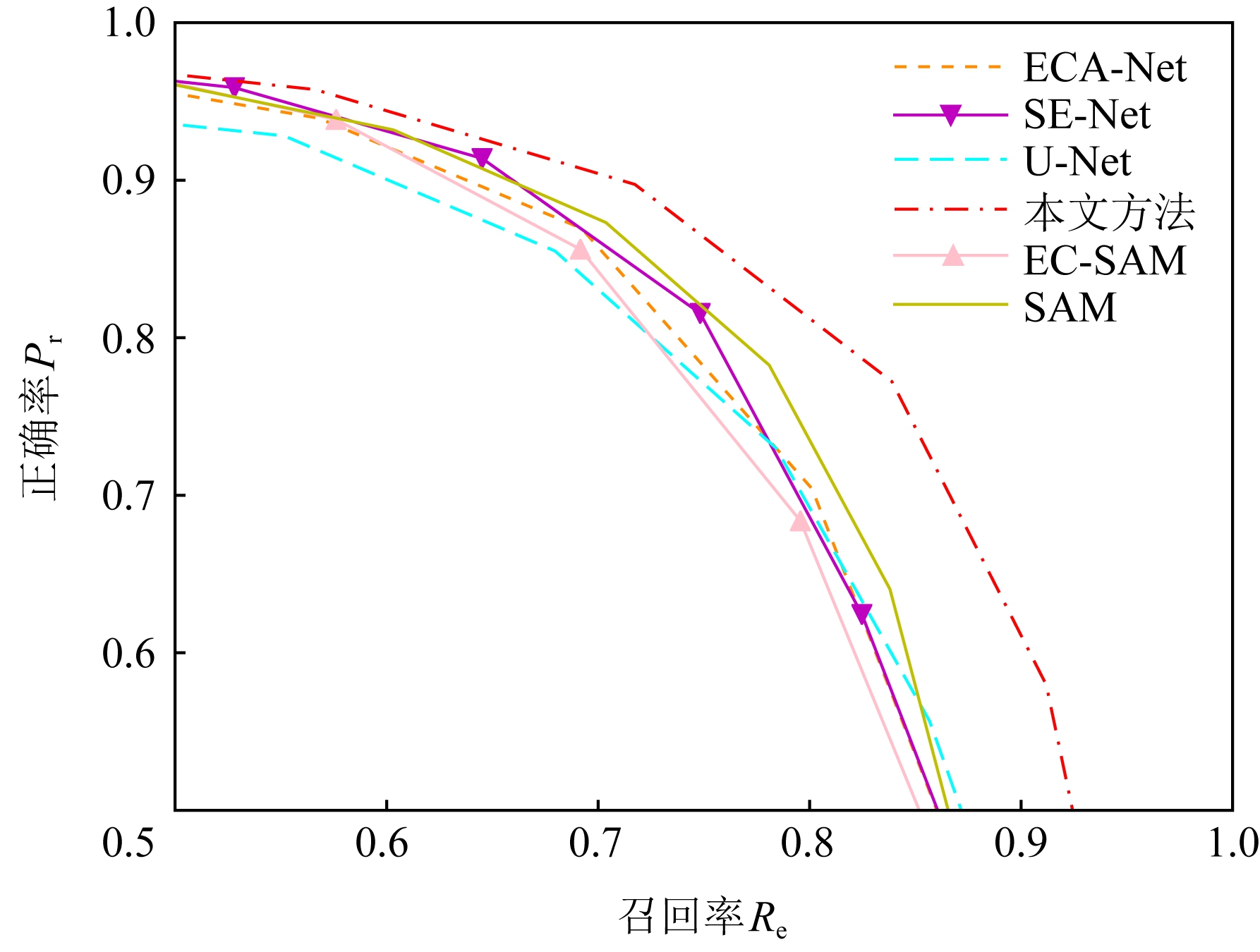

表3是本组实验的具体结果,数据显示在添加注意力机制后,网络的性能都有所提高,且本文设计的并行注意力机制效果最好,性能提升了2.95%.图6是本组实验的PR曲线,图中显示本文设计的并行注意力机制性能最佳,而EC-SAM的性能最差,其原因在于串行结构的注意力机制在裂缝检测中易受到明亮噪声干扰,降低检测效果,而本文方法能有效抑制各种干扰,大大提高检测性能.

Table 3 The Results of Different Attention Mechanisms

表3 不同注意力机制的对比结果

方法PrReF1UNet0.74790.81220.7519SE-Net0.77760.75150.7626ECA-Net0.84340.68180.7716SAM0.78810.76990.7693EC-SAM0.76800.81910.7692本文方法0.77980.82180.7814

注:黑体数字表示该指标最好的结果.

Fig. 6 PR curve of these attention mechanisms

图6 添加不同注意力机制后的PR曲线

4 结 论

本文设计了一种并行注意力机制,并将其嵌入到UNet中.该注意力机制采用并行结构,不仅能有效抑制各种干扰,而且能获取更具互补性的裂缝特征,从而解决了串行结构注意力机制在裂缝检测中的不足.实验结果表明,本文方法优于现有的主流网络,且相较于其他注意力机制,本文设计的并行注意力机制在裂缝检测中效果最好.

作者贡献声明:刘凡提出了本文方法,进行了实验设计、论文撰写与修改;王君锋设计完成了实验,并进行论文的撰写;陈峙宇辅助完成实验;许峰提供了实验数据集,并在论文撰写修改过程中提供意见与建议.

[1]Liang Shiqing, Sun Bocheng. Using wavelet technology for pavement crack detection[C] //Proc of the 2010 Int Conf of Logistics Engineering and Management. Reston,VA: ASCE, 2010: 2479-2484

[2]Deng Yingxiao, Tang Jiebin. Application of wavelet analysis in identification of bridge structural damage[J]. Journal of Southern Yangtze University: Natural Science Edition, 2011, 10(6): 693-696 (in Chinese)(邓迎晓, 唐杰彬. 基于小波分析的桥梁损伤检测[J]. 江南大学学报: 自然科学版, 2011, 10(6): 693-696)

[3]Akagic A, Buza E, Omanovic S, et al. Pavement crack detection using Otsu thresholding for image segmentation[C] //Proc of the 41st Int Convention on Information and Communication Technology, Electronics and Microelectronics(MIPRO). Piscataway, NJ: IEEE, 2018: 1092-1097

[4]Oliveira H, Correia P L. Automatic road crack segmentation using entropy and image dynamic thresholding[C] //Proc of the 17th European Signal Processing Conf. Piscataway, NJ: IEEE, 2009: 622-626

[5]Liu Sheng. Method of shadow pavement crack extraction based on improved local threshold segmentation[J]. Wireless Internet Technology, 2018, 15(20): 112-113 (in Chinese)(刘晟. 基于改进的局部阈值分割的阴影路面裂缝提取方法[J]. 无线互联科技, 2018, 15(20): 112-113)

[6]Nguyen T, Begot S, Duculty F, et al. Pavement cracking detection using an anisotropy measurement[C] //Proc of the 11th IASTED Int Conf on Computer Graphics and Imaging(CGIM). Calgary, Canada: Acta Press, 2010: 80-87

[7]Xu Wei, Tang Zhenmin, Zhou Jun, et al. Pavement crack detection based on saliency and statistical features[C] //Proc of the 2013 IEEE Int Conf on Image Processing. Piscataway, NJ: IEEE, 2013: 4093-4097

[8]Zhao Huili, Qin Guofeng, Wang Xingjian. Improvement of canny algorithm based on pavement edge detection[C] //Proc of the 3rd Int Congress on Image and Signal Processing. Piscataway, NJ: IEEE, 2010: 964-967

[9]Albert A P, Nii A O. Evaluating pavement cracks with bidimensional empirical mode decomposition[J]. Eurasip Journal on Advances in Signal Processing, 2008, 2008(1): 1-7

[10]Ling Yong, Wang Guoyou. A new algorithm for detecting freeway cracks contour[J]. Computer & Digital Engineering, 2001, 29(3): 18-25 (in Chinese)(凌勇, 汪国有. 高速公路裂缝边缘检测算法研究[J]. 计算机与数字工程, 2001, 29(3): 18-25)

[11]Kirschke K R, Velinsky S A. Histogram-based approach for automated pavement-crack sensing[J]. Journal of Transportation Engineering, 1992, 118(5): 700-710

[12]Teomete E, Amin V R, Ceylan H. Digital image processing for pavement distress analyses [C] //Proc of the 2005 Mid-Continent Transportation Research Symp. Ames, IA: Iowa State University, 2005: 1-13

[13]Xu Zhigang, Zhao Xiangmo, Song Huansheng, et al. Asphalt pavement crack recognition algorithm based on histogram estimation and shape analysis[J]. Chinese Journal of Scientific Instrument, 2010, 31(10): 102-108 (in Chinese)(徐志刚, 赵祥模, 宋焕生, 等. 基于直方图估计和形状分析的沥青路面裂缝识别算法[J]. 仪器仪表学报, 2010, 31(10): 102-108)

[14]Cha Y J, Choi W, Buyukozturk O. Deep learning-based crack damage detection using convolutional neural networks[J]. Computer Aided Civil & Infrastructure Engineering, 2017, 32(5): 361-378

[15]Zhu Li, Mao Huaqing, Hang Bo, et al.A handheld device for wall crack recognition based on target detection: China, CN201911370924.X[P]. 2019-12-26 (in Chinese)(朱丽, 毛华庆, 杭波, 等. 基于目标检测的墙面裂缝识别手持设备: 中国, CN201911370924.X[P]. 2019-12-26)

[16]Li Shengyuan, Zhao Xuefeng. Image-based concrete crack detection using convolutional neural network and exhaustive search technique[J]. Advances in Civil Engineering, 2019, 2019(4): 1-12

[17]Kailkhura V, Aravindh S, Jha S S, et al. Ensemble learning-based approach for crack detection using CNN[C] //Proc of the 4th Int Conf on Trends in Electronics and Informatics(ICOEI). Piscataway, NJ: IEEE, 2020: 808-815

[18]Fan Zhun, Wu Yuming, Lu Jiewei, et al. Automatic pavement crack detection based on structured prediction with the convolutional neural network[C] //Proc of the Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2018: 1-9

[19]Qu Zhong, Mei Jing, Liu Ling, et al. Crack detection of concrete pavement with cross-entropy loss function and improved VGG16 network model[J]. IEEE Access, 2020, 2020(8): 54564-54573

[20]Zhao Shanshan, He Ning. Road surface crack detection based on CNN[J]. Transducer and Microsystem Technologies, 2017, 36(11): 135-138 (in Chinese)(赵珊珊, 何宁. 基于卷积神经网络的路面裂缝检测[J]. 传感器与微系统, 2017, 36(11): 135-138)

[21]Fang Fen, Li Liyuan, Rice M, et al. Towards real-time crack detection using a deep neural network with a bayesian fusion algorithm[C] //Proc of the 2019 IEEE Int Conf on Image Processing(ICIP). Piscataway, NJ: IEEE, 2019: 2976-2980

[22]Liao Rongguo. Detection and analysis of concrete crack based on neural network[J]. Sichuan Building Materials, 2012, 38(2): 20-21 (in Chinese)(廖荣国. 基于神经网络的混凝土裂缝检测分析[J]. 四川建材, 2012, 38(2): 20-21)

[23]Yao Gang, Wei Fujia, Qian Jiye, et al. Crack detection of concrete surface based on convolutional neural networks[C] //Proc of the 2018 Int Conf on Machine Learning and Cybernetics(ICMLC). Piscataway, NJ: IEEE, 2018: 246-250

[24]Liu Zhenqing, Cao Yiwen, Wang Yize, et al. Computer vision-based concrete crack detection using UNet fully convolutional networks[J]. Automation in Construction, 2019, 104(AUG.): 129-139

[25]Ali L, Valappil N K, Kareem D N A, et al. Pavement crack detection and localization using convolutional neural networks(CNNs)[C] //Proc of the 2019 Int Conf on Digitization(ICD). Piscataway, NJ: IEEE, 2019: 217-221

[26]Nie Mingxin, Wang Cheng. Pavement crack detection based on Yolo v3[C] //Proc of the 2nd Int Conf on Safety Produce Informatization(IICSPI). Piscataway, NJ: IEEE, 2019: 327-330

[27]Song Weidong, Jia Guohui, Jia Di, et al. Automatic pavement crack detection and classification using multiscale feature attention network[J]. IEEE Access, 2019, 2019(7): 171001-171012

[28]Xiang Xuezhi, Zhang Yuqi, Saddik A E. Pavement crack detection network based on pyramid structure and attention mechanism[J]. IET Image Processing, 2020, 14(8): 1580-1586

[29]Konig J, Jenkins M D, Barrie P, et al. A convolutional neural network for pavement surface crack segmentation using residual connections and attention gating[C] //Proc of the 2019 IEEE Int Conf on Image Processing(ICIP). Piscataway, NJ: IEEE, 2019: 1460-1464

[30]Wang Leipeng, Ma Xianghua, Ye Yinzhong. Computer vision-based road crack detection using an improved I-UNet convolutional networks[C] //Proc of the 2020 Chinese Control and Decision Conf(CCDC). Piscataway, NJ: IEEE, 2020: 539-543

[31]Fan Zhun, Li Chong, Chen Ying, et al. Automatic crack detection on road pavements using encoder-decoder architecture[J]. Materials, 2020, 13(13): 1-18

[32]Li Shengyuan, Zhao Xuefeng. Image-based concrete crack detection using convolutional neural network and exhaustive search technique[J]. Advances in Civil Engineering, 2019, 2019(2019): 1-12

[33]Li Gang, Ma Biao, He Shuanhai, et al. Automatic tunnel crack detection based on UNet and a convolutional neural network with alternately updated clique[J]. Sensors, 2020, 20(3): 1-22

[34]Ren Yupeng, Huang Jisheng, Hong Zhiyou, et al. Image-based concrete crack detection in tunnels using deep fully convolutional networks[J]. Construction and Building Materials, 2020, 2020(234): 1-12

[35]Borenstein E, Sharon E, Ullman S. Combining top-down and bottom-up segmentation[C] //Proc of the 2004 IEEE Conf on Computer Vision and Pattern Recognition Workshop. Piscataway, NJ: IEEE, 2004: 46-46

[36]Svoboda D, Ulman V, Kovac P, et al. Vascular network formation in silico using the extended cellular potts model[C] //Proc of the 23rd IEEE Int Conf on Image Processing. Piscataway, NJ: IEEE, 2016: 3180-3183

[37]Badrinarayanan V, Kendall A, Cipolla R. SegNet: A deep convolutional encoder-decoder architecture for image segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(12): 2481-2495

[38]Simonyan K, Zisserman A. Very deep convolutional networks for large-scale image recognition[C] //Proc of the Int Conf on Learning Representations(ICLR). Piscataway, NJ: IEEE, 2015: 1-14

[39]Hu Jie, Shen Li, Sun Gang. Squeeze-and-excitation networks[C] //Proc of the IEEE Conf on Computer Vision and Pattern Recognition(CVPR). Piscataway, NJ: IEEE, 2018: 7132-7141

[40]Wang Qilong, Wu Banggu, Zhu Pengfei, et al. ECA-Net: Efficient channel attention for deep convolutional neural networks[C] //Proc of the IEEE Conf on Computer Vision and Pattern Recognition(CVPR). Piscataway, NJ: IEEE, 2020: 11534-11542

[41]Wang Junfeng, Liu Fan, Yang Wenjie, et al. Pavement crack detection using attention UNet with multiple sources[C] //Proc of the Chinese Conf on Pattern Recognition and Computer Vision. Berlin: Springer, 2020: 664-672

[42]Brank J, Mladenic D, Grobelnik M, et al. F-Measure[M]. Berlin: Springer, 2010

[43]Xu Wei, Tang Zhenmin, Lü Jianyong. Pavement crack detection based on image saliency[J]. Journal of Image and Graphics, 2013, 18(1): 69-77 (in Chinese)

(徐威, 唐振民, 吕建勇. 基于图像显著性的路面裂缝检测[J]. 中国图象图形学报, 2013, 18(1): 69-77)

[44]Woo S, Park J, Lee J Y, et al. CBAM: Convolutional block attention module[C] //Proc of the European Conf on Computer Vision(ECCV). Piscataway, NJ: IEEE, 2018: 3-19